「看面相識(shí)別罪犯」論文要上Nature?遭1700名科學(xué)家聯(lián)名反對(duì)

有 1700 名研究者簽字聯(lián)名抵制 Nature 出版一篇 AI 研究論文,這可是頭一次。

「我們敦促審核委員會(huì)公開(kāi)撤銷論文通過(guò)的決定,并解釋評(píng)估該論文通過(guò)的標(biāo)準(zhǔn)。Springer 需要公開(kāi)聲明譴責(zé)使用刑事司法統(tǒng)計(jì)數(shù)據(jù)預(yù)測(cè)犯罪行為,并承認(rèn)其過(guò)去在激勵(lì)這種有害學(xué)術(shù)方面的作用。所有出版商今后都不要發(fā)表類似的研究。」

在一份長(zhǎng)長(zhǎng)的公開(kāi)信中,數(shù)千名 AI 研究人員呼吁科學(xué)出版商 Springer Nature 不要發(fā)表一篇論文。據(jù)介紹,該研究提出了一種面部識(shí)別系統(tǒng),能夠預(yù)測(cè)一個(gè)人是否為犯罪分子。這篇論文由美國(guó)哈里斯堡科技大學(xué)(Harrisburg University of Science and Technology)提交。

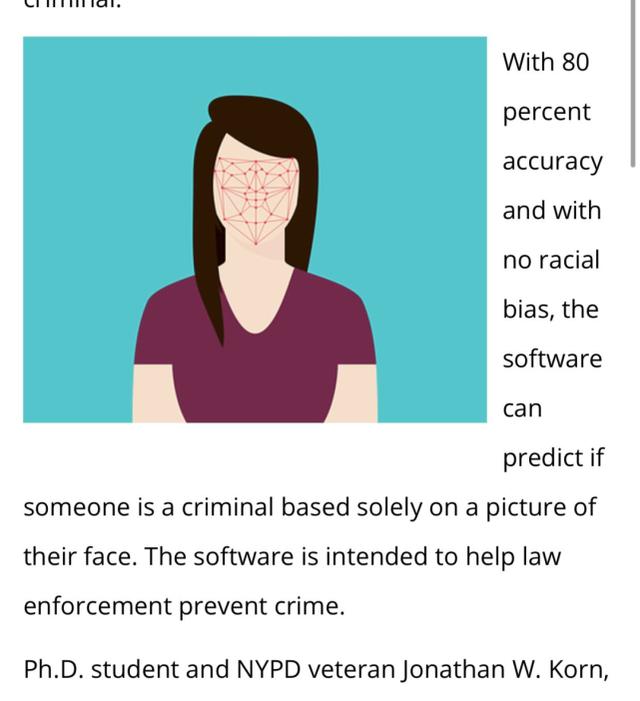

是什么研究引發(fā)了如此爭(zhēng)議?在這篇名為《A Deep Neural Network Model to Predict Criminality Using Image Processing》的論文中,研究人員稱該技術(shù)沒(méi)有種族偏見(jiàn),根據(jù)照片中人的面部特征預(yù)測(cè)是否為罪犯的準(zhǔn)確性達(dá)到了 80%,這一深度學(xué)習(xí)方法是面向執(zhí)法機(jī)構(gòu)開(kāi)發(fā)的。

這篇論文的第一作者,哈里斯堡科技大學(xué)在讀博士 Jonathan Korn 是一名前紐約警察。同為論文作者的 Roozbeh Sadeghian 教授在論文提交的新聞中表示:「我們知道機(jī)器學(xué)習(xí)技術(shù)在與面部識(shí)別和情感檢測(cè)有關(guān)的各種任務(wù)上可實(shí)現(xiàn)超過(guò)人類的水平。新研究表明,這些工具可以從圖像中提取出高度可預(yù)測(cè)犯罪的微小特征,這證明了新方法的強(qiáng)大。」

在原先的計(jì)劃中,這篇論文會(huì)被收錄在《自然》研究叢書「Springer Nature – Research Book Series: Transactions on Computational Science & Computational Intelligence」中。

「通過(guò)無(wú)偏見(jiàn)地自動(dòng)識(shí)別潛在威脅,我們可以實(shí)現(xiàn)預(yù)防犯罪的目標(biāo),為執(zhí)法部門和軍事應(yīng)用提供受到隱形偏見(jiàn)和情感因素更小的工具,」論文作者之一的 Nathaniel Ashby 表示。「我們的下一步是尋找合作伙伴以推進(jìn)這一使命。」

然而事情并不如作者所想的那樣順利。在新聞發(fā)布之后,「AI 看人臉預(yù)測(cè)犯罪」的研究很快引發(fā)了不小的爭(zhēng)議。在社交網(wǎng)絡(luò)上,業(yè)界專家就效率、隱私和道德等原則達(dá)成了共識(shí),稱該計(jì)劃不負(fù)責(zé)任、牽強(qiáng)附會(huì)且「錯(cuò)得離譜」,因?yàn)檫@可能引出 AI 判斷一些人是天生罪犯的奇怪結(jié)果。

在論文提交后,哈里斯堡科技大學(xué)的新聞稿。在 5 月份這篇新聞因爭(zhēng)議過(guò)大又被刪除。

自 5 月論文提交的消息被曝出后,這一研究一直被科學(xué)界關(guān)注與討論。在最近的公開(kāi)信中,已經(jīng)有來(lái)自哈佛大學(xué)、MIT、谷歌以及微軟的學(xué)者和 AI 領(lǐng)域的專家在這封公開(kāi)信上簽字。他們呼吁出版公司 Springer 停止發(fā)表這篇論文:「我們是來(lái)自不同科技領(lǐng)域、學(xué)科和人文領(lǐng)域的研究者及從業(yè)人員,我們對(duì)于即將出版的論文深表關(guān)注。」

公開(kāi)信的組織者之一 Audrey Beard 在一份郵件聲明中表示:「根本無(wú)法開(kāi)發(fā)出不存在種族偏見(jiàn)的犯罪預(yù)測(cè)系統(tǒng),因?yàn)樾淌滤痉〝?shù)據(jù)本身就是存在種族偏見(jiàn)的。」

這已經(jīng)不是 AI 研究者第一次提出這樣令人質(zhì)疑的研究了。

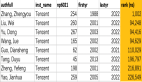

根據(jù)人的相貌來(lái)評(píng)估犯罪幾率,這讓人們想到了 2016 年 11 月上海交大提交到預(yù)印版論文平臺(tái) arXiv 上的論文《使用臉部圖像自動(dòng)推斷罪犯》,研究者聲稱通過(guò)大量證件照片的訓(xùn)練,神經(jīng)網(wǎng)絡(luò)模型可以在識(shí)別罪犯時(shí)準(zhǔn)確率達(dá)到 87%。在當(dāng)年,該研究也曾引起學(xué)術(shù)界和輿論界的大量討論。

昨晚,Nature 作出了澄清,哈里斯堡科技大學(xué)的文章不會(huì)被《自然》雜志出版:

但還是有人繼續(xù)質(zhì)問(wèn):「為什么這樣的文章會(huì)進(jìn)入 Nature 的審核流程?」看來(lái)想要消除深度學(xué)習(xí)的偏見(jiàn),避免其成為「作惡」的工具,我們還有很多事情要做。

公開(kāi)信:

https://medium.com/@CoalitionForCriticalTechnology/abolish-the-techtoprisonpipeline-9b5b14366b16