模仿川普語(yǔ)氣真假難分:從未如此逼真,超強(qiáng)編故事AI完全體來(lái)了

本文經(jīng)AI新媒體量子位(公眾號(hào)ID:QbitAI)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

還記得那個(gè)編故事能以假亂真的AI模型嗎?

它叫GPT-2,因?yàn)樾Ч茫琌penAI說(shuō)不能放出全部——讓壞人誤用就不好了。

于是,它初出茅廬時(shí)先放出了124M版本的模型,然后是355M,再然后是774M。

被業(yè)內(nèi)稱為“擠牙膏式開(kāi)源”。

然而沒(méi)想到,經(jīng)過(guò)9個(gè)月斷斷續(xù)續(xù)發(fā)布,OpenAI終于把15億參數(shù)的完整模型,放了出來(lái)。

正所謂好飯不怕晚,官方版放出之后也引起了好多人圍觀。

有人說(shuō)“好人一生平安”。也有人給OpenAI點(diǎn)贊,說(shuō)唯一安全的AI,就是面向所有人的AI,而不是少數(shù)人的AI。

不少人也感嘆于15億參數(shù)模型的效果,表示“假論文”的時(shí)代不遠(yuǎn)了。

但更多的人是想扒清楚:

這個(gè)當(dāng)初“吊炸天”的AI模型,到底有沒(méi)有那么玄乎?

實(shí)測(cè)15億版本模型

先來(lái)看看我們上手測(cè)試的效果吧。

首先,我們問(wèn)它對(duì)熬夜變傻有科學(xué)依據(jù)了怎么看,輸入是這樣的:

There’s scientific evidence that staying up late makes you stupid.

它竟然給出了一個(gè)Twitter體的回答,還順便Q了一下川建國(guó):

There’s scientific evidence that staying up late makes you stupid. So why is it okay for the president to be up late every night, and be tweeting?

https://t.co/0j5cFZ5sXS — The Daily Show (@TheDailyShow) January 6, 2017

熬夜變傻有科學(xué)依據(jù)了。那么,為什么總統(tǒng)每天晚上很晚才起床,還要發(fā)推呢?

https://t.co/0j5cFZ5sXS—TheDailyShow (@TheDailyShow) 2017年1月6日

Here’s where Trump got it right:

這就是特朗普認(rèn)為這樣做正確的地方:

If I had been a wiser man, I would have used the term “sad” to describe my feelings toward watching all of you go to sleep. Sad! — Donald J. Trump (@realDonaldTrump) January 6, 2017

如果我是個(gè)明智的人,我就會(huì)用“難過(guò)”這個(gè)詞來(lái)形容我看著你們所有人入睡的感受。難過(guò)!

—唐納德·特朗普(@realDonaldTrump) 2017年1月6日

甚至還有推文鏈接、具體的賬號(hào)和時(shí)間。

嚇得我們趕緊去查了查,還好鏈接是胡編的,根本打不開(kāi)。但這些推文賬號(hào)都存在。

如此效果,很讓我們震驚,將這個(gè)感受輸入進(jìn)去:

The editors were shocked by the effect.

然后得到了這樣的“胡編”生成結(jié)果:

A few years later, in the late 1990s, a book was published that offered evidence for the existence of a “gene for human intelligence.”

幾年后,也就是20世紀(jì)90年代末,一本書出版了,為“人類智力基因”的存在提供了證據(jù)。

“I’m just astonished that this is the case,” said Robert Rosenthal, a psychologist at the University of California at San Diego who was one of the editors of the report.

“我只是對(duì)這種情況感到驚訝,”加州大學(xué)圣地亞哥分校的心理學(xué)家、該報(bào)告的編輯之一羅伯特·羅森塔爾說(shuō)。

Rosenthal called the notion that intelligence can be detected with DNA “totally implausible.”

羅森塔爾稱,智力可以通過(guò) DNA 檢測(cè)的說(shuō)法“完全不可信”

雖然真實(shí)性有待考證,但這個(gè)邏輯已經(jīng)像模像樣,而且有細(xì)節(jié)、有論證,不了解實(shí)情的人,可能真的會(huì)被忽悠過(guò)去。

模型更大,胡編的能力也更強(qiáng)了

OpenAI在博客里說(shuō),GPT-2的生成結(jié)果,有獨(dú)立客觀第三方的檢驗(yàn),令人信服:

團(tuán)隊(duì)在康奈爾大學(xué)的合作伙伴,對(duì)人類做了問(wèn)卷調(diào)查,給GPT-2輸出的文本打出可信分 (Credibility Score) ,各種大小的模型都參與了。

滿分10分,大家給15億參數(shù)模型的可信分是6.91。比7.74億參數(shù)的模型 (6.72分) 和 3.55億參數(shù)的模型 (6.07分) 都要高。

也就是說(shuō)在人類眼里,15億參數(shù)模型,比之前放出的那些模型,寫出的文章更逼真了。

那么在AI眼里,會(huì)不會(huì)也是如此?

于是寫個(gè)檢測(cè)算法,識(shí)別哪些是GPT-2寫的文章,哪些是人類寫的文章,同樣是一項(xiàng)重要的工作。

OpenAI做了一個(gè)檢測(cè)模型,識(shí)別15億模型生成的文本,準(zhǔn)確率大約95%。但這還不代表AI生成的文本是安全的。

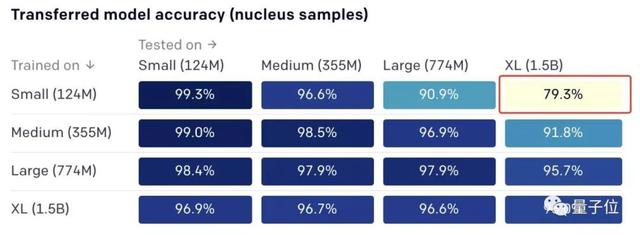

因?yàn)椋瑘F(tuán)隊(duì)又對(duì)檢測(cè)算法做了更仔細(xì)的考察,跨數(shù)據(jù)集的那種。

比如,訓(xùn)練時(shí)用3.55億參數(shù)模型的作品,測(cè)試時(shí)卻要識(shí)別15億參數(shù)模型的文章;訓(xùn)練針對(duì)15億參數(shù)模型,測(cè)試時(shí)要識(shí)別3.55億參數(shù)模型的作品等等。

結(jié)果如下:

目前看來(lái),用大模型的作品當(dāng)訓(xùn)練集,可以輕松識(shí)別小模型的作品;但用小模型的作品當(dāng)訓(xùn)練集,要識(shí)別大模型的作品,頗有些難度。

比如,用1.24億參數(shù)模型的文章訓(xùn)練之后,再讓算法識(shí)別15億參數(shù)模型的作品,準(zhǔn)確率只有79.3%。反過(guò)來(lái),準(zhǔn)確率有96.9%。

總體來(lái)看,15億參數(shù)模型的作品,依然是最難識(shí)別的。

得出這樣的結(jié)果,一方面看出15億參數(shù)模型比從前的模型更強(qiáng)大。另一方面,也表示檢測(cè)真?zhèn)蔚乃惴ㄟ€有很長(zhǎng)的路要走。

但也有人指出了這個(gè)模型存在的另外一些問(wèn)題:

文本生成模型夠大了,但我們需要的是可控的文本生成。

使用建議

所以,這個(gè)版本的GPT-2應(yīng)該怎么用?

首先,當(dāng)然是到GPT-2的GitHub倉(cāng)庫(kù)里下載15億參數(shù)版完整模型,自己動(dòng)手調(diào)教出你想要的功能。

https://github.com/openai/gpt-2

不過(guò),這比較適合AI專業(yè)人士操作。有人讀了源碼之后,直言頭大:

1、到處是單字母變量;2、代碼本身幾乎沒(méi)有文檔;3、到處都是魔術(shù)常數(shù);4、函數(shù)名過(guò)于簡(jiǎn)潔。

如果你想立刻上手嘗試,已經(jīng)有人把代碼移植到了Colab上。

https://colab.research.google.com/drive/1BXry0kcm869-RVHHiY6NZmY9uBzbkf1Q

并且還推出了配套的GPT-2調(diào)教教程《GPT-2神經(jīng)網(wǎng)絡(luò)詩(shī)歌》。

https://www.gwern.net/GPT-2

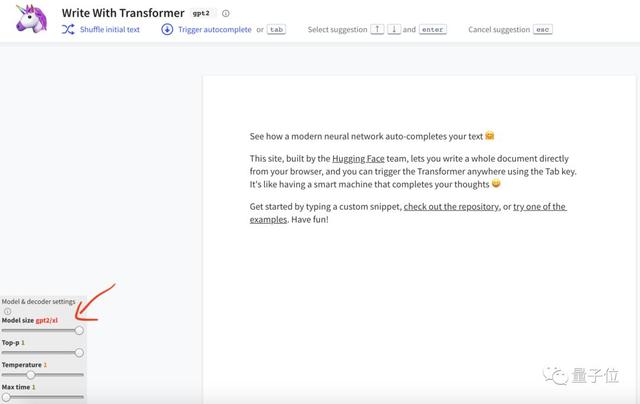

此外,Hugging Face(抱抱臉)也已經(jīng)第一時(shí)間將這一模型添加到了萬(wàn)星項(xiàng)目Transformers中,一個(gè)API就能調(diào)用GPT-2 15億參數(shù)版本。在線上Demo中也已經(jīng)可以直接試用。

https://transformer.huggingface.co/doc/gpt2-xl

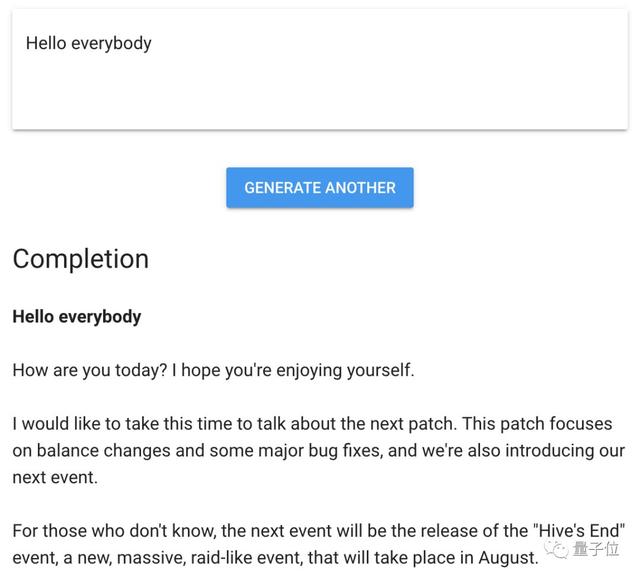

如果你只是想體驗(yàn)一下效果,還有人在網(wǎng)站上集成了GPT-2 15億參數(shù)模型的功能,輸入開(kāi)頭,即可一鍵生成文本。

https://talktotransformer.com/

按照OpenAI的預(yù)期,這一完整模型將主要服務(wù)于AI研究人員和從業(yè)人員,幫助人們更好地理解生成語(yǔ)言模型的行為、功能、偏見(jiàn)和約束。

下一步往哪里去?

不難看出,OpenAI發(fā)布的15億最大參數(shù)模型在輸出等方面還是取得了一定的進(jìn)步。但同時(shí),OpenAI也提出了在檢測(cè)方面所面臨的挑戰(zhàn)。

那么接下來(lái),他們又會(huì)對(duì)這個(gè)模型做出怎樣的改進(jìn)呢?

OpenAI表示:

在過(guò)去9個(gè)月的體驗(yàn)時(shí)間里,我們深刻的了解到了在AI領(lǐng)域發(fā)布一個(gè)規(guī)范模型所帶來(lái)的挑戰(zhàn)與機(jī)遇。我們將繼續(xù)在模型規(guī)范方面進(jìn)行進(jìn)一步的研究與討論。

隨著進(jìn)一步的研究,我們期望語(yǔ)言模型能夠在性能上有更大的提升,以此提供更高的輸出質(zhì)量和準(zhǔn)確性。

因此,為了有效的塑造語(yǔ)言模型的社會(huì)影響,OpenAI還確定了四個(gè)需要監(jiān)控的趨勢(shì)。

趨勢(shì)一:語(yǔ)言模型正在向設(shè)備轉(zhuǎn)移

考慮到計(jì)算能力成本的歷史趨勢(shì),以及當(dāng)前在設(shè)備上執(zhí)行機(jī)器學(xué)習(xí)訓(xùn)練或推斷的速度,OpenAI預(yù)言:預(yù)言模型將更廣泛地部署在一系列的設(shè)備上,而不是服務(wù)器集群。

趨勢(shì)二:文本生成將變得更加可控

語(yǔ)言模型的潛在用途將得益于可靠性/可控性的發(fā)展,例如新的采樣方法、數(shù)據(jù)集、目標(biāo)函數(shù)以及人機(jī)界面。

趨勢(shì)三:更多風(fēng)險(xiǎn)分析

目前,如何比較具有不同性能配置文件的兩種大型語(yǔ)言模型的可用性還有待商榷,尤其是在考慮微調(diào)的情況下。

一些主要的考慮因素包括:在沒(méi)有模型的情況下,借助于模型來(lái)產(chǎn)生給定數(shù)量的一定質(zhì)量的文本所需的時(shí)間和專業(yè)知識(shí)。

除了在生成不同樣式的惡意內(nèi)容時(shí)的性能差異之外,不同的模型或多或少將更容易適應(yīng)不同的語(yǔ)言和主題。

而在不犧牲某些靈活性的情況下,將誤用的可能性降低到零似乎是困難的或不可能的。

還需要進(jìn)一步的研究以及發(fā)展倫理規(guī)范來(lái)權(quán)衡這些問(wèn)題。

趨勢(shì)四:提高工具的可用性

現(xiàn)如今,模型的訓(xùn)練和部署需要機(jī)器學(xué)習(xí)技術(shù)的知識(shí),工具技能以及訪問(wèn)測(cè)試平臺(tái)進(jìn)行評(píng)估的知識(shí)。

與語(yǔ)言模型交互的工具(例如與Transformer的對(duì)話和使用Transformer接口的編寫),將擴(kuò)大能夠以各種不同方式使用語(yǔ)言模型的參與者的數(shù)量。

這些對(duì)工具可用性的改進(jìn)將會(huì)對(duì)模型性能和抽樣方法起到改進(jìn)的作用,使得更廣泛的創(chuàng)造性語(yǔ)言模型應(yīng)用成為可能。

One more thing:GPT-2宇宙

從今天2月份,GPT-2橫空出世之后,強(qiáng)悍的效果讓不少人的震驚,無(wú)需針對(duì)性訓(xùn)練就能橫掃各種特定領(lǐng)域的語(yǔ)言建模任務(wù),還具備閱讀理解、問(wèn)答、生成文章摘要、翻譯等等能力。

于是也引起了大家研究GPT-2的熱潮,將GPT-2帶到了各種各樣的場(chǎng)景下。

比如,有人給GPT-2加上“人類偏好”補(bǔ)丁,它說(shuō)的話就越來(lái)越有人情味了。也有人用它做出了程序員沸騰的項(xiàng)目:殺手級(jí)AI補(bǔ)代碼工具,支持23種語(yǔ)言及5種主流編輯器。

還有中文版GPT-2,可以寫詩(shī),新聞,小說(shuō)、劇本,或是訓(xùn)練通用語(yǔ)言模型。

GPT-2 Chinese項(xiàng)目傳送門:

https://github.com/Morizeyao/GPT2-Chinese

正如OpenAI所說(shuō)的,以及GPT-2所展現(xiàn)出來(lái)的能力,它的潛力遠(yuǎn)遠(yuǎn)不僅于此。

它還能夠用到更多的場(chǎng)景中。

不知道你有沒(méi)有大膽的想法?