8B文字多模態大模型指標逼近GPT4V,字節、華師、華科聯合提出TextSquare

近期,多模態大模型 (MLLM) 在文本中心的 VQA 領域取得了顯著進展,尤其是多個閉源模型,例如:GPT4V 和 Gemini,甚至在某些方面展現了超越人類能力的表現。但是開源模型的性能還遠遠落后于閉源模型,最近許多開創性的研究,例如:MonKey、LLaVAR、TG-Doc、ShareGPT4V 等已開始關注指令微調數據不足的問題。盡管這些努力取得了顯著的效果,但仍存在一些問題,圖像描述數據和 VQA 數據屬于不同的領域,圖像內容呈現的粒度和范圍存在不一致性。此外,合成數據的規模相對較小,使得 MLLM 無法充分發揮潛力。

- 論文標題:TextSquare: Scaling up Text-Centric Visual Instruction Tuning

- 論文地址:https://arxiv.org/abs/2404.12803

為了減少這一差距,來自字節跳動 & 華東師大 & 華中科大的研究員提出了一種新的策略:Square--- 即從先進的閉源 MLLMs 中獲得大量的以文本中心的高質量 VQA 數據,并構建了一個千萬級指令微調數據集(Square-10M)。

VQA 數據生成

Square 策略方法包括四個步驟:自問 (Self-Questioning)、回答 (Self-Answering)、推理 (Self-Reasoning) 和評估 (Self-Evalution)。Self-Questioning 利用 MLLM 在文本圖像分析和理解方面的能力生成與圖像中文本內容相關的問題。Self-Answering 利用各種提示技術,如:思維鏈 CoT 和少樣本,提示回答這些問題。Self-Reasoning 利用 MLLMs 強大的推理能力,生成模型背后的推理過程。Self-Evalution 評估問題的有效性、與圖像文本內容的相關性以及答案的正確性,從而提高數據質量并減少幻覺。

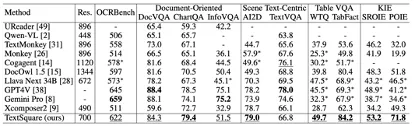

圖 1 TextSquare 和先進的閉源、開源模型的比較,在 10 個文本相關的 benchmark 上的平均排名超越了 GPT4V(排名 2.2 vs. 2.4)

基于 Square 方法,研究者從各種公共來源收集了一組多樣化的含有大量文本的圖像,包括自然場景、圖表、表單、收據、書籍、PPT、PDF 等構建了 Square-10M,并基于這個數據集訓練了以文本理解為中心的 MLLM TextSquare-8B。

如圖 1 所示,TextSquare-8B 在多個 benchmark 可取得與 GPT4V 和 Gemini 相媲美或更優的效果,并顯著超過了其他開源模型。TextSquare 實驗驗證了推理數據對 VQA 任務的積極影響,證明了其能夠在減少幻覺的同時提升模型性能。

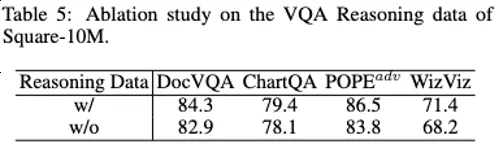

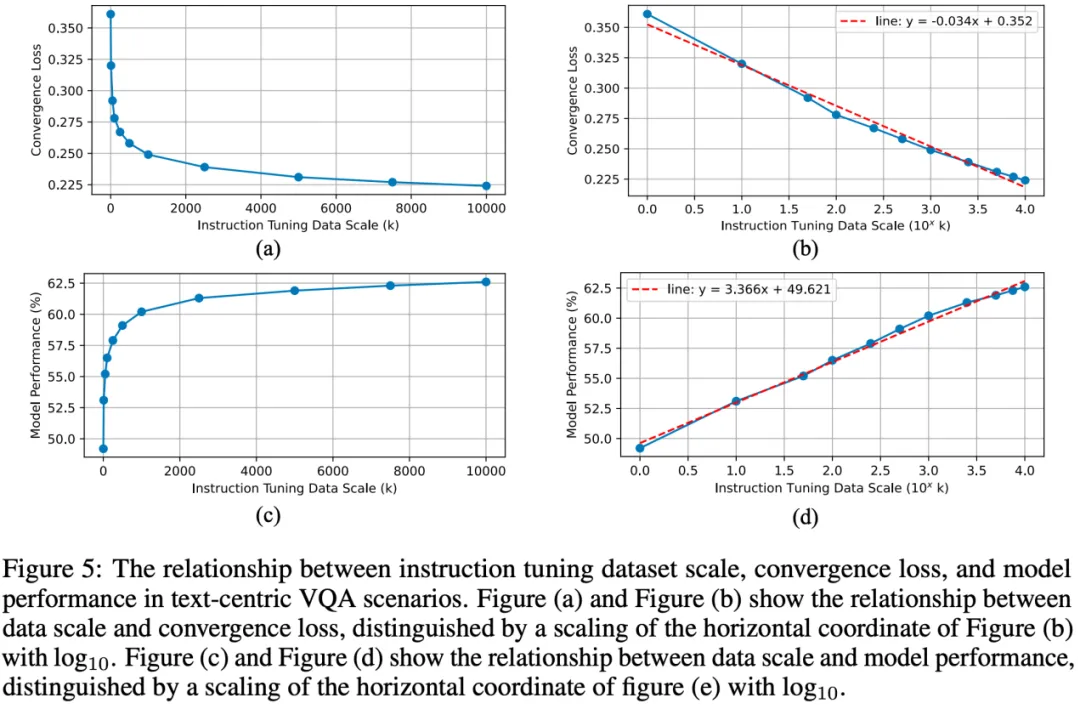

此外,通過利用大規模的數據集,揭示了指令調整數據規模、訓練收斂損失和模型性能之間的關系。盡管少量的指令調整數據可以很好地訓練 MLLM,隨著指令調整數據的不斷擴大,模型的性能能得到進一步增長,指令微調數據和模型之間也存在著相對應的 scaling law。

圖 2 VQA 數據合成的流程,包括數據生成(Self-Questioning、 Answering、Reasoning)、數據過濾(Evaluation)2 個階段

圖 3 Square-10M 的圖像分布和 QA 分布等詳細情況

數據收集

數據收集策略的主要目標是涵蓋廣泛的現實世界文本豐富的場景。為此,研究者收集了 380 萬張的富文本的圖像。這些圖像表現出不同的特性,例如,圖表和表格側重于具有密集統計信息的文本元素;PPT、屏幕截圖和 WebImage 是為文本和突出視覺信息之間的交互而設計的;文檔 / PDF、收據和電子商務包含具有精細和密集文本的圖像;街景源于自然場景。收集到的圖像形成了現實世界中文本元素的映射,并構成了研究以文本為中心的 VQA 的基礎。

數據生成

研究者利用 Gemini Pro 的多模態理解能力從特定數據源選擇圖像,并通過自問、自答、自我推理三個階段生成 VQA 及推理上下文對。

- Self-Question: 這個階段會給定一些 prompt,Gemini Pro 會根據這些提示對圖像進行全面分析,并根據理解去生成一些有意義的問題。考慮到通用 MLLM 對文本元素的理解能力通常會比視覺模型弱,我們通過專門的 OCR 模型將提取的文本預處理到 prompt 中去。

- Self-Answering: Gemini Pro對生成問題會利用思維鏈 (CoT) 和少樣本提示 (few-shot prompting) 等技術豐富上下文信息,提高生成答案的可靠性。

- Self-Reasoning:這個階段會生成答案的詳細原因,迫使 Gemini Pro 更多的思考問題和視覺元素之間的聯系,從而減少幻覺并提高準確的答案。

數據過濾

盡管自我提問、回答和推理是有效的,但生成的圖像 - 文本對可能面臨幻覺內容、無意義問題和錯誤答案。因此,我們設計了基于 LLM 的評估能力的過濾規則,以選擇高質量的 VQA 對。

- Self-Evaluation提示 Gemini Pro 和其他 MLLMs 判斷生成的問題是否有意義,以及答案是否足以正確解決問題。

- Multi-Prompt Consistency 除了直接評估生成的內容外,研究者還在數據生成中手動增加提示和上下文空間。當提供不同的提示時,一個正確且有意義的 VQA 對應該在語義上一致。

- Multi-Context Consistency 研究者通過在問題前準備不同的上下文信息來進一步驗證 VQA 對。

TextSquare-8B

TextSquare-8B 借鑒了 InternLM-Xcomposer2 的模型結構,包括 CLIP ViT-L-14-336 的視覺 Encoder,圖像分辨率進一步提升至 700;基于 InternLM2-7B-ChatSFT 的大語言模型 LLM;一個對齊視覺和文本 token 的橋接器 projector。

TextSquare-8B 的訓練包括三階段的 SFT:

第一階段,以 490 的分辨率全參數 (Vision Encoder, Projector, LLM) 微調模型。

第二階段,輸入分辨率增加到 700,只訓練 Vision Encoder 以適應分辨率變化。

第三階段,進一步以 700 的分辨率進行全參數微調。

TextSquare 證實,在 Square-10M 數據集的基礎上,具有 8B 參數和正常大小圖像分辨率的模型可以在以文本為中心的 VQA 上實現超過了大多數的 MLLM,甚至是閉源模型 (GPT4V、Gemini Pro) 的效果。

實驗結果

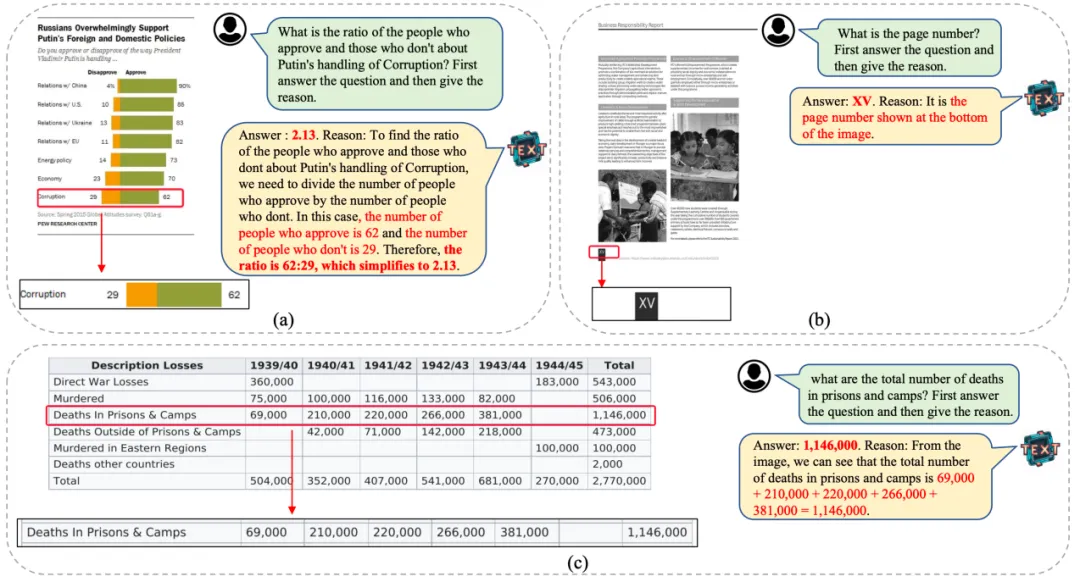

圖 4(a)顯示 TextSquare 具有簡單的算術功能。圖 4(b)顯示了理解文本內容并在密集文本中提供大致位置的能力。圖 4(c)顯示了 TextSquare 對表格結構的理解能力。

MLLM Benchmark

- Document-Oriented Benchmark 在文檔場景的 VQA Benckmark (DocVQA、ChartQA、InfographicVQA) 上平均提升 3.5%,優于所有開源模型,在 ChartQA 數據集上略高于 GPT4V 和 Gemini Pro,該模型分辨率僅 700,小于大多數面向文檔的 MLLM,如果分辨率進一步提高,相信模型性能也將進一步提高,Monkey 已證明這一點。

- Scene Text-centric Benchmark自然場景的 VQA Benchmark (TextVQA、AI2D) 中取得了 SOTA 的效果,但與 baseline Xcomposer2 相比沒有較大改進,可能是因為 Xcomposer2 已經用了高質量的域內數據進行了充分優化。

- Table VQA Benchmark 表格場景的 VQA Benchmark (WTQ、TabFact) 中取得到遠超 GPT4V 及 Gemini Pro 的效果,分別超過其他 SOTA 模型 3%。

- Text-centric KIE Benchmark文本中心的關鍵信息提取 KIE 任務的 benchmark (SROIE、POIE),將 KIE 任務轉換成 VQA 任務,在兩個數據集都取得了最佳的性能,平均提升 14.8%。

- OCRBench 包括文本識別、公式識別、文本中心 VQA、KIE 等 29 項 OCR 相關的評估任務,取得了開源模型的最佳性能,并成為第一個 10B 左右參數量達到 600 分的模型。

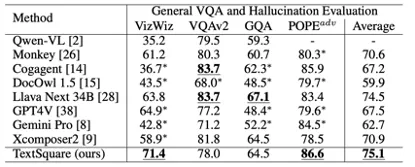

- General VQA and Hallucination Evaluation Benchmark在通用的 VQA Benchmark (VizWiz VQAv2、GQA、POPE) 上 TextSquare 相較于 Xconposer2 沒有顯著退化,仍然保持著最佳的性能,在 VisWiz 和 POPE 表現出顯著的性能,比各最佳的方法高出 3.6%,這突出了該方法的有效性,能減輕模型幻覺。

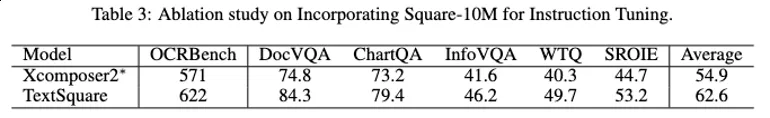

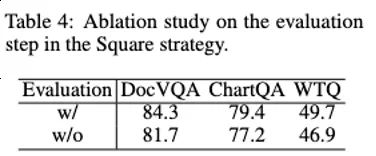

消融實驗

TextSquare 相較于 Xcomposer2 在各 benchmark 平均提升 7.7%。

加入自評估后,模型性能有了明顯提升。

加入推理數據后有助于顯著提升性能以及減輕幻覺生成。

數據規模和收斂 loss & 模型性能關系

隨著數據規模的增長,模型的 loss 繼續減少,而下降速度逐漸變慢。收斂損失和指令調整數據尺度之間的關系近似符合對數函數。

隨著指令調優數據的增長,模型的性能越來越好,但增長速度繼續放緩,也大致符合對數函數。

總體而言,在以文本為中心的 VQA 場景中,在指令調整階段存在相應的縮放定律,其中模型性能與數據縮放的對數成正比,可以指導潛在更大數據集的構建并預測模型性能。

總結

在本文中,研究者提出了構建高質量的以文本為中心的指令調優數據集(Square-10M)的 Square 策略,利用該數據集,TextSquare-8B 在多個 benchmark 上實現了與 GPT4V 相當的性能,并在各種基準測試上大幅優于最近發布的開源模型。

此外,研究者推導了指令調整數據集規模、收斂損失和模型性能之間的關系,以便為構建更大的數據集鋪平道路,證實了數據的數量和質量對模型性能至關重要。

最后,研究者指出,如何進一步提高數據數量和質量以縮小開源模型與領先模型之間的差距,被認為一個有高度希望的研究方向。

本文轉自 機器之心 ,作者:機器之心