DDPG算法輕松解決AI醫療機器人技術難題:連續動作控制 原創

本文旨在探索DDPG算法如何解決連續動作控制難題,從而進一步提升生物工程領域AI驅動的醫療機器人的強大功能。

引言

想象一下,你正在手術過程中控制著一臺機械臂。此機械臂的離散動作可能有:

- 向上移動

- 向下移動

- 抓取

或

- 釋放

這些都是明確、直接的命令,在簡單情況下是易于執行的。但是,如果執行精細的動作,例如:

- 將手臂移動0.5毫米以避免損傷組織

- 施加3N的力以壓縮組織

或

- 旋轉手腕15°以調整切口角度

該怎么辦呢?

在這些情況下,你需要的不僅僅是選擇一個動作——你必須決定需要多少動作。這是連續動作空間的世界,也是深度確定性策略梯度(DDPG)算法大放異彩的地方!

像深度Q網絡(DQN)這樣的傳統方法在離散動作方面效果很好,但在連續動作方面卻舉步維艱。另一方面,確定性策略梯度(DPG)算法解決了這個問題,但面臨著探索性差和不穩定的挑戰。DDPG算法最早是在TP.Lillicrap等人的論文中提出的,它結合了DPG算法和DQN算法的優勢,以提高連續動作空間環境中的穩定性和性能。

在本文中,我們將討論DDPG算法背后的理論和架構,研究它在Python上的實現,評估其性能(通過在MountainCarContinuous游戲上進行測試),并簡要討論如何在生物工程領域使用DDPG算法。

DDPG算法架構

與評估每個可能的“狀態-動作”對以找到最佳動作(由于組合無限,在連續空間中不可能)的DQN算法不同,DPG算法使用的是“演員-評論家(Actor-Critic)”架構。演員學習一種將狀態直接映射到動作的策略,避免詳盡的搜索并專注于學習每個狀態的最佳動作。

但是,DPG算法面臨兩個主要挑戰:

- 它是一種確定性算法,限制了對動作空間的探索。

- 由于學習過程不穩定,它無法有效地使用神經網絡。

DDPG算法通過Ornstein-Uhlenbeck過程引入探索噪聲,并使用批量歸一化和DQN技術(如重放緩沖區和目標網絡)穩定訓練,從而改進了DPG算法。

借助這些增強功能,DDPG算法非常適合在連續動作空間中訓練AI代理,例如在生物工程應用中控制機器人系統。

接下來,讓我們深入探索DDPG模型的關鍵組成!

演員-評論家(Actor-Critic)框架

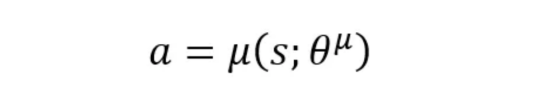

- 演員(策略網絡):根據代理所處的狀態告訴代理要采取哪種操作。網絡的參數(即權重)用θμ表示。

【提示】將演員網絡視為決策者:它將當前狀態映射到單個動作。

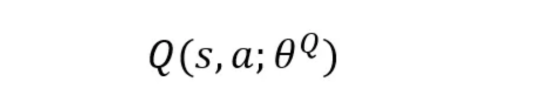

- 評論家(Q值網絡):通過估計該狀態-動作對的Q值來評估演員采取的行動有多好。

提示!將CriticNetwork視為評估者,它為每個動作分配一個質量分數,并幫助改進演員的策略,以確保它確實在每個給定狀態下生成最佳動作。

注意!評論家將使用估計的Q值做兩件事:

1. 改進演員的策略(演員策略更新)。

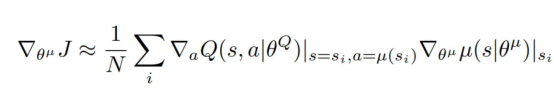

演員的目標是調整其參數(θμ),以便輸出最大化評論家的Q值的動作。

為此,演員需要了解所選動作a如何影響評論家的Q值,以及其內部參數如何影響其策略,這通過此策略梯度方程完成(它是從小批量計算出的所有梯度的平均值):

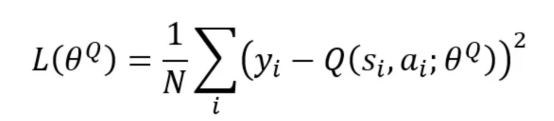

2. 通過最小化下面的損失函數來改進其自己的網絡(評論家Q值網絡更新)。

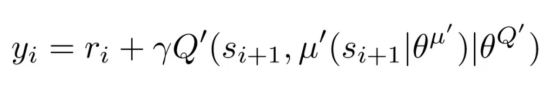

其中,N是在小批量中采樣的經驗數,y_i是按如下方式計算的目標Q值。

重放緩沖區

當代理探索環境時,過去的經驗(狀態、動作、獎勵、下一個狀態)會作為元組(s,a,r,s′)存儲在重放緩沖區中。在訓練期間,會隨機抽取由其中一些經驗組成的小批量來訓練代理。

問題!重放緩沖區實際上如何減少不穩定性?

通過隨機抽取經驗,重放緩沖區打破了連續樣本之間的相關性,減少了偏差并帶來了更穩定的訓練。

目標網絡

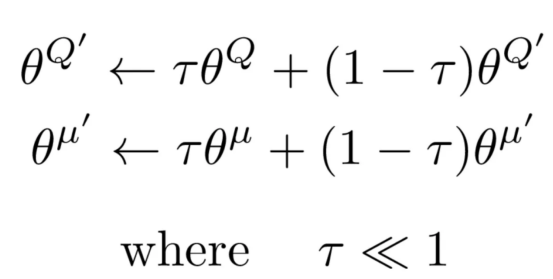

目標網絡是演員和評論家的緩慢更新副本。它們提供穩定的Q值目標,防止快速變化并確保平穩、一致的更新。

【問題】目標網絡實際上如何減少不穩定性?

如果沒有評論家目標網絡,則目標Q值直接從評論家Q值網絡計算,該網絡會不斷更新。這會導致目標Q值在每一步都發生變化,從而產生“移動目標”問題。因此,評論家最終會追逐不斷變化的目標,導致訓練不穩定。

此外,由于演員依賴于評論家的反饋,因此一個網絡中的錯誤會放大另一個網絡中的錯誤,從而形成相互依賴的不穩定循環。

通過引入使用軟更新規則逐步更新的目標網絡,我們確保目標Q值保持更一致,從而減少突然變化并提高學習穩定性。

批量歸一化

批量歸一化將輸入歸一化到神經網絡的每一層,確保平均值為零且方差為1個單位。

【問題】批量歸一化實際上如何減少不穩定性?

從重放緩沖區中提取的樣本可能具有與實時數據不同的分布,從而導致網絡更新期間不穩定。

批量歸一化確保輸入的一致縮放,以防止由輸入分布變化引起的不穩定更新。

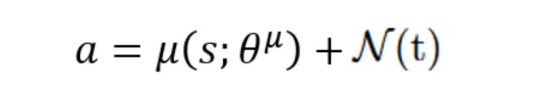

探索噪聲

由于演員的策略是確定性的,因此在訓練期間將探索噪聲添加到動作中,以鼓勵代理探索盡可能多的動作空間。

在DDPG論文中,作者使用Ornstein-Uhlenbeck過程生成時間相關噪聲,以模擬現實世界的系統動態。

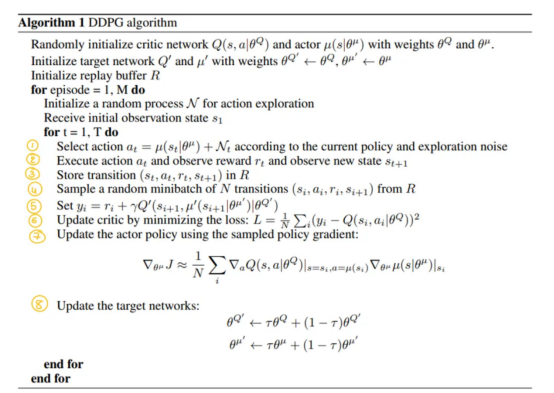

DDPG算法偽代碼:分步分解

此偽代碼取自http://arxiv.org/abs/1509.02971(參見“參考文獻1”)。

- 定義演員和評論家網絡:

class Actor(nn.Module):

"""

針對DDPG算法的演員網絡。

"""

def __init__(self, state_dim, action_dim, max_action,use_batch_norm):

"""

初始化演員的策略網絡

:參數state_dim: 狀態空間的維度

:參數action_dim: 動作空間的維度

:參數max_action: 動作的最大值

"""

super(Actor, self).__init__()

self.bn1 = nn.LayerNorm(HIDDEN_LAYERS_ACTOR) if use_batch_norm else nn.Identity()

self.bn2 = nn.LayerNorm(HIDDEN_LAYERS_ACTOR) if use_batch_norm else nn.Identity()

self.l1 = nn.Linear(state_dim, HIDDEN_LAYERS_ACTOR)

self.l2 = nn.Linear(HIDDEN_LAYERS_ACTOR, HIDDEN_LAYERS_ACTOR)

self.l3 = nn.Linear(HIDDEN_LAYERS_ACTOR, action_dim)

self.max_action = max_action

def forward(self, state):

"""

通過網絡正向傳播。

:參數state: 輸入狀態

:返回值: 動作

"""

a = torch.relu(self.bn1(self.l1(state)))

a = torch.relu(self.bn2(self.l2(a)))

return self.max_action * torch.tanh(self.l3(a))

class Critic(nn.Module):

"""

針對DDPG算法的評論家網絡。

"""

def __init__(self, state_dim, action_dim,use_batch_norm):

"""

初始化評論家的值網絡。

:參數state_dim: 狀態空間的維度

:參數action_dim: 動作空間的維度

"""

super(Critic, self).__init__()

self.bn1 = nn.BatchNorm1d(HIDDEN_LAYERS_CRITIC) if use_batch_norm else nn.Identity()

self.bn2 = nn.BatchNorm1d(HIDDEN_LAYERS_CRITIC) if use_batch_norm else nn.Identity()

self.l1 = nn.Linear(state_dim + action_dim, HIDDEN_LAYERS_CRITIC)

self.l2 = nn.Linear(HIDDEN_LAYERS_CRITIC, HIDDEN_LAYERS_CRITIC)

self.l3 = nn.Linear(HIDDEN_LAYERS_CRITIC, 1)

def forward(self, state, action):

"""

通過網絡的正向傳播。

:參數state:輸入狀態

:參數action: 輸入動作

:返回值: “狀態-動作”對的Q-值

"""

q = torch.relu(self.bn1(self.l1(torch.cat([state, action], 1))))

q = torch.relu(self.bn2(self.l2(q)))

return self.l3(q)- 定義重放緩沖區

實現ReplayBuffer類來存儲和采樣上一節中討論的轉換元組(s,a,r,s’),以實現小批量離策略學習。

class ReplayBuffer:

def __init__(self, capacity):

self.buffer = deque(maxlen=capacity)

def push(self, state, action, reward, next_state, done):

self.buffer.append((state, action, reward, next_state, done))

def sample(self, batch_size):

return random.sample(self.buffer, batch_size)

def __len__(self):

return len(self.buffer)- 定義OU噪聲類

添加OUNoise類來生成探索噪聲,幫助代理更有效地探索動作空間。

"""

節選自??https://github.com/vitchyr/rlkit/blob/master/rlkit/exploration_strategies/ou_strategy.py??

"""

class OUNoise(object):

def __init__(self, action_space, mu=0.0, theta=0.15, max_sigma=0.3, min_sigma=0.3, decay_period=100000):

self.mu = mu

self.theta = theta

self.sigma = max_sigma

self.max_sigma = max_sigma

self.min_sigma = min_sigma

self.decay_period = decay_period

self.action_dim = action_space.shape[0]

self.low = action_space.low

self.high = action_space.high

self.reset()

def reset(self):

self.state = np.ones(self.action_dim) * self.mu

def evolve_state(self):

x = self.state

dx = self.theta * (self.mu - x) + self.sigma * np.random.randn(self.action_dim)

self.state = x + dx

return self.state

def get_action(self, action, t=0):

ou_state = self.evolve_state()

self.sigma = self.max_sigma - (self.max_sigma - self.min_sigma) * min(1.0, t / self.decay_period)

return np.clip(action + ou_state, self.low, self.high)- 定義DDPG代理

定義了一個DDPG類,它負責封裝代理的行為:

初始化:創建演員和評論家網絡,以及它們的目標對應方和重放緩沖區。

class DDPG():

"""

深度確定性策略梯度(DDPG)代理。

"""

def __init__(self, state_dim, action_dim, max_action,use_batch_norm):

"""

初始化DDPG算法代理。

:參數state_dim: 狀態空間的維度

:參數action_dim: 動作空間的維度

:參數max_action: 動作的最大值

"""

# [第0步]

#初始化演員的策略網絡

self.actor = Actor(state_dim, action_dim, max_action,use_batch_norm)

# 使用與演員的策略網絡相同的權重初始化演員目標網絡

self.actor_target = Actor(state_dim, action_dim, max_action,use_batch_norm)

self.actor_target.load_state_dict(self.actor.state_dict())

self.actor_optimizer = optim.Adam(self.actor.parameters(), lr=ACTOR_LR)

#初始化評論家的值網絡

self.critic = Critic(state_dim, action_dim,use_batch_norm)

#使用與評論家的值網絡相同的權重初始化評論家的目標網絡

self.critic_target = Critic(state_dim, action_dim,use_batch_norm)

self.critic_target.load_state_dict(self.critic.state_dict())

self.critic_optimizer = optim.Adam(self.critic.parameters(), lr=CRITIC_LR)

#初始化重放緩沖區

self.replay_buffer = ReplayBuffer(BUFFER_SIZE)動作選擇:select_action方法根據當前策略選擇動作。

def select_action(self, state):

"""

根據當前狀態選擇一個動作。

:參數state:當前狀態

:返回值:選擇的動作

"""

state = torch.FloatTensor(state.reshape(1, -1))

action = self.actor(state).cpu().data.numpy().flatten()

return action訓練:訓練方法定義了如何使用重放緩沖區中的經驗來更新網絡。

注意:由于本文介紹了使用目標網絡和批量歸一化來提高穩定性,因此我設計了訓練方法,允許我們打開或關閉這些方法。這讓我們可以比較代理在使用和不使用它們的情況下的性能。請參閱下面的代碼以了解詳細的實現。

def train(self, use_target_network,use_batch_norm):

"""

訓練DDPG代理

:參數use_target_network: 是否使用目標網絡

:參數use_batch_norm: 是否使用批量歸一化

"""

if len(self.replay_buffer) < BATCH_SIZE:

return

# [第4步]. 從重放緩沖區中抽取一批樣本

batch = self.replay_buffer.sample(BATCH_SIZE)

state, action, reward, next_state, done = map(np.stack, zip(*batch))

state = torch.FloatTensor(state)

action = torch.FloatTensor(action)

next_state = torch.FloatTensor(next_state)

reward = torch.FloatTensor(reward.reshape(-1, 1))

done = torch.FloatTensor(done.reshape(-1, 1))

#評論家網絡更新#

if use_target_network:

target_Q = self.critic_target(next_state, self.actor_target(next_state))

else:

target_Q = self.critic(next_state, self.actor(next_state))

# [第5步]. 計算目標Q-value (y_i)

target_Q = reward + (1 - done) * GAMMA * target_Q

current_Q = self.critic(state, action)

critic_loss = nn.MSELoss()(current_Q, target_Q.detach())

# [第6步]. 使用梯度下降來更新評論家網絡的權重

#以最小化損失函數

self.critic_optimizer.zero_grad()

critic_loss.backward()

self.critic_optimizer.step()

#更新演員網絡#

actor_loss = -self.critic(state, self.actor(state)).mean()

# [第7步]. 使用梯度下降來更新演員網絡的權重

#以最小化損失函數和最大化Q-value => 選擇產生最高累積獎勵的動作

self.actor_optimizer.zero_grad()

actor_loss.backward()

self.actor_optimizer.step()

# [第8步]. 更新目標網絡

if use_target_network:

for param, target_param in zip(self.critic.parameters(), self.critic_target.parameters()):

target_param.data.copy_(TAU * param.data + (1 - TAU) * target_param.data)

for param, target_param in zip(self.actor.parameters(), self.actor_target.parameters()):

target_param.data.copy_(TAU * param.data + (1 - TAU) * target_param.data)- 訓練DDPG代理

將所有定義的類和方法整合在一起,我們就可以訓練DDPG代理。我的train_dppg函數遵循偽代碼和DDPG模型圖結構。

提示:為了讓你更容易理解,我已將每個代碼部分標記為偽代碼和圖表中相應的步驟編號。希望對你有所幫助!

def train_ddpg(use_target_network, use_batch_norm, num_episodes=NUM_EPISODES):

"""

訓練DDPG代理

:參數use_target_network: 是否使用目標網絡

:參數use_batch_norm: 是否使用批量歸一化

:參數num_episodes: 需要訓練的回合數

:返回值: 回合獎勵列表

"""

agent = DDPG(state_dim, action_dim, 1,use_batch_norm)

episode_rewards = []

noise = OUNoise(env.action_space)

for episode in range(num_episodes):

state= env.reset()

noise.reset()

episode_reward = 0

done = False

step=0

while not done:

action_actor = agent.select_action(state)

action = noise.get_action(action_actor,step) # Add noise for exploration

next_state, reward, done,_= env.step(action)

done = float(done) if isinstance(done, (bool, int)) else float(done[0])

agent.replay_buffer.push(state, action, reward, next_state, done)

if len(agent.replay_buffer) > BATCH_SIZE:

agent.train(use_target_network,use_batch_norm)

state = next_state

episode_reward += reward

step+=1

episode_rewards.append(episode_reward)

if (episode + 1) % 10 == 0:

print(f"Episode {episode + 1}: Reward = {episode_reward}")

return agent, episode_rewards性能和結果:DDPG算法有效性評估

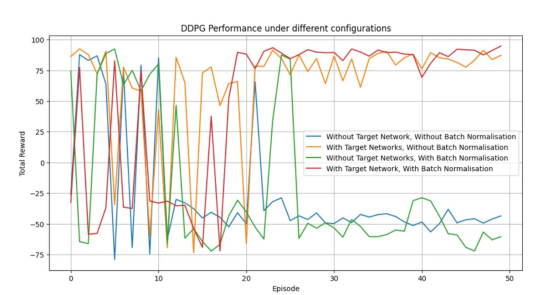

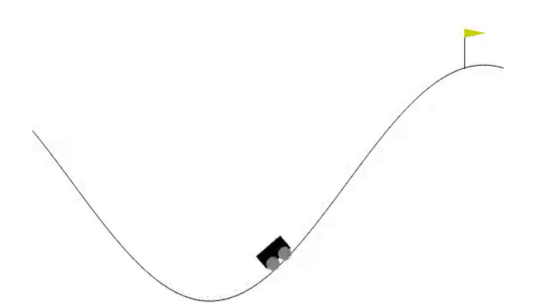

至此,我們已經在MountainCarContinuous-v0環境中測試了DDPG算法在連續動作空間中的有效性。在該環境中,代理學會了如何獲得動力以將汽車開上陡峭的山坡。結果表明,與其他配置相比,使用目標網絡和批量歸一化可以實現更快的收斂、更高的獎勵和更穩定的學習。

作者本人生成的圖表

作者本人生成的GIF動畫

注意:你可以通過運行從我的?GitHub代碼倉庫??下載的代碼并根據需要更改環境名稱,然后在你選擇的任何環境中自行實現此功能!

生物工程領域的DDPG算法:高精度和適應性

通過本文的介紹,我們已經看到DDPG是一種強大的算法,可用于在具有連續動作空間的環境中訓練代理。通過結合DPG算法和DQN算法的技術,DDPG算法可以提高探索、穩定性和性能——這正是機器人手術和生物工程應用的關鍵因素。

想象一下,像達芬奇系統(da Vinci system)這樣的機器人外科醫生使用DDPG實時控制精細動作,確保精確調整而不會出現任何錯誤。借助DDPG算法,機器人可以以毫米為單位調整手臂的位置,在縫合時施加精確的力,甚至可以輕微旋轉手腕以獲得最佳切口。這種實時精度可以改變手術結果,縮短恢復時間,并最大限度地減少人為錯誤。

但DDPG算法的潛力不僅限于醫學手術領域。它已經推動了生物工程的發展,使機器人假肢和輔助設備能夠復制人類肢體的自然運動(有興趣的讀者可以查看這篇有趣的文章:??https://www.tandfonline.com/doi/abs/10.1080/00207179.2023.2201644??)。

現在,我們已經介紹了DDPG算法背后的理論,是時候由你來探索它的實際應用了。你可以從簡單的例子開始,逐漸深入到更復雜的實戰場景!

參考文獻

- Lillicrap TP、Hunt JJ、Pritzel A、Heess N、Erez T、Tassa Y等人。使用深度強化學習的連續控制(Continuous control with deep reinforcement learning [Internet])。arXiv;2019年。出處:http://arxiv.org/abs/1509.02971

譯者介紹

朱先忠,51CTO社區編輯,51CTO專家博客、講師,濰坊一所高校計算機教師,自由編程界老兵一枚。

原文標題:??Understanding DDPG: The Algorithm That Solves Continuous Action Control Challenges??,作者:Sirine Bhouri