這才是真?開源模型!公開「后訓(xùn)練」一切,性能超越Llama 3.1 Instruct

在最近關(guān)于「Scaling Law 是否撞墻」的討論中,后訓(xùn)練(post-training)被寄予厚望。

眾所周知,近期發(fā)布的 OpenAI o1 在數(shù)學(xué)、 代碼、長程規(guī)劃等問題上取得了顯著提升,而背后的成功離不開后訓(xùn)練階段強化學(xué)習(xí)訓(xùn)練和推理階段思考計算量的增大。基于此,有人認為,新的擴展律 —— 后訓(xùn)練擴展律(Post-Training Scaling Laws) 已經(jīng)出現(xiàn),并可能引發(fā)社區(qū)對于算力分配、后訓(xùn)練能力的重新思考。

不過,對于后訓(xùn)練到底要怎么做,哪些細節(jié)對模型性能影響較大,目前還沒有太多系統(tǒng)的資料可以參考,因為這都是各家的商業(yè)機密。

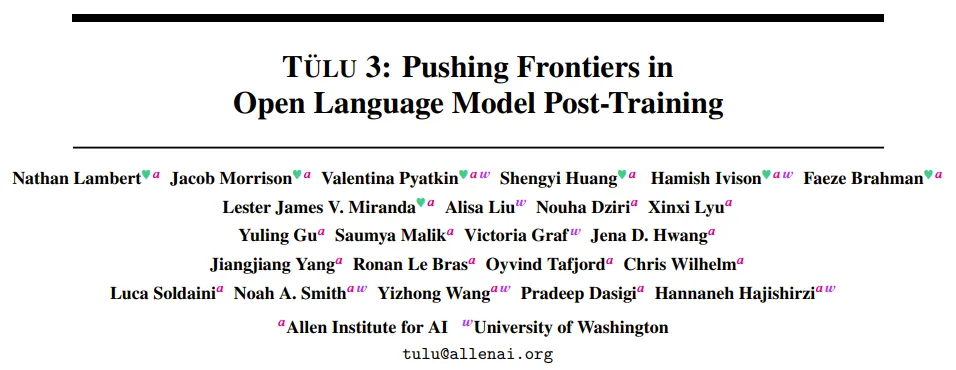

剛剛,曾經(jīng)重新定義「開源」并發(fā)布了史上首個 100% 開源大模型的艾倫人工智能研究所(Ai2)站出來打破了沉默。他們不僅開源了兩個性能超過 Llama 3.1 Instruct 相應(yīng)版本的新模型 ——Tülu 3 8B 和 70B(未來還會有 405B 版本),還在技術(shù)報告中公布了詳細的后訓(xùn)練方法。

Ai2 研究科學(xué)家 Nathan Lambert(論文一作)的推文

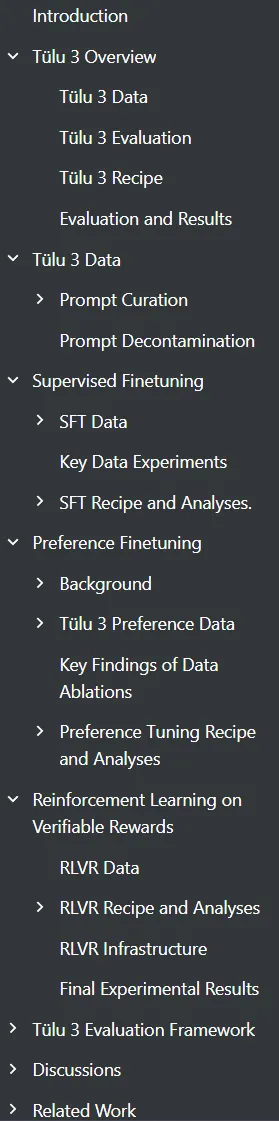

這份 70 多頁的技術(shù)報告可以說誠意滿滿,非常值得詳細閱讀:

Tülu 3 發(fā)布后,社區(qū)反響熱烈,甚至有用戶表示測試后發(fā)現(xiàn)其表現(xiàn)比 GPT-4o 還好。

另外,Nathan Lambert 還暗示未來可能基于 Qwen 來訓(xùn)練 Tülu 模型。

機器之心也簡單測試了下 Tülu。首先,數(shù) Strawberry 中 r 數(shù)量的問題毫無意外地出錯了,至于其編寫的笑話嘛,好像也不好笑。

本地部署 AI 模型的工具 Ollama 也第一時間宣布已經(jīng)支持該模型。

機器之心也簡單通過 Ollama 和 Obsidian 的插件簡單體驗了一下 8B 的本地版本,看起來效果還不錯,速度也很快。

不過,比模型性能更值得關(guān)注的或許還是 Tülu 3 的后訓(xùn)練方案。在這套方案的啟發(fā)下,眾多研究者有望在大模型的后訓(xùn)練階段進行更多嘗試,延續(xù)大模型的 Scaling Law。

首個發(fā)布后訓(xùn)練詳情的開源模型

在提升模型性能方面,后訓(xùn)練的作用越來越大,具體包括微調(diào)和 RLHF 等。此前,OpenAI、 Anthropic、Meta 和谷歌等大公司已經(jīng)大幅提升了其后訓(xùn)練方法的復(fù)雜度,具體包括采用多輪訓(xùn)練范式、使用人類數(shù)據(jù) + 合成數(shù)據(jù)、使用多個訓(xùn)練算法和訓(xùn)練目標。也正因為此,這些模型的通用性能和專業(yè)能力都非常強。但遺憾的是,他們都沒有透明地公開他們的訓(xùn)練數(shù)據(jù)和訓(xùn)練配方。

到目前為止,開源后訓(xùn)練一直落后于封閉模型。在 LMSYS 的 ChatBotArena 排行榜上,前 50 名(截至 2024 年 11 月 20 日)中沒有任何一個模型發(fā)布了其后訓(xùn)練數(shù)據(jù)。即使是主要的開放權(quán)重模型也不會發(fā)布任何數(shù)據(jù)或用于實現(xiàn)這種后訓(xùn)練的配方細節(jié)。

于是,Ai2 似乎看不下去了,決定開源一切!

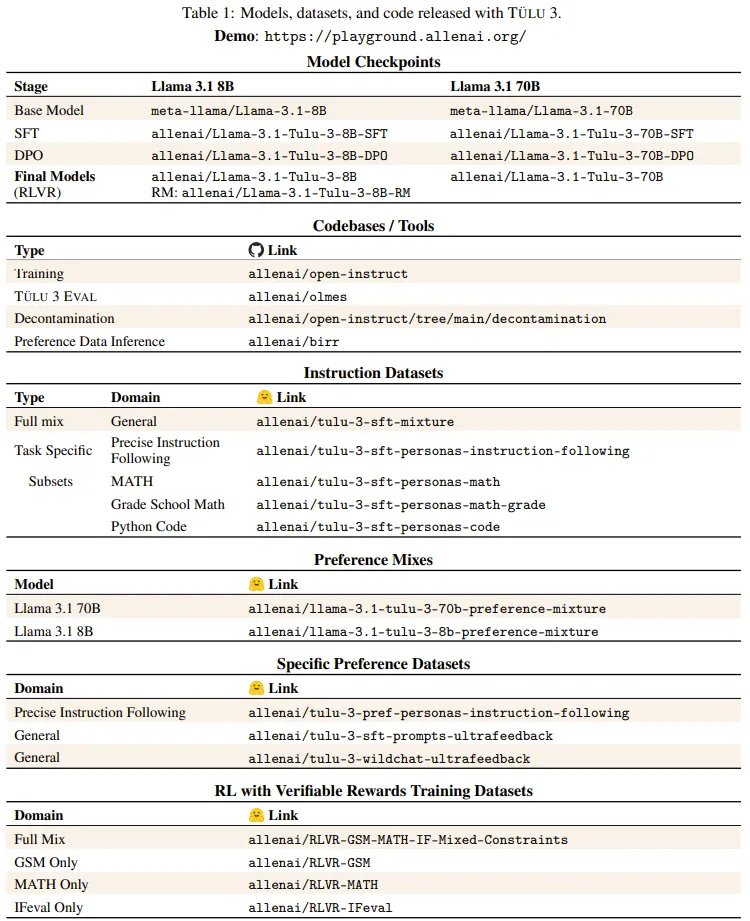

Tülu 3 模型之外,Ai2 還發(fā)布了所有的數(shù)據(jù)、數(shù)據(jù)混合方法、配方、代碼、基礎(chǔ)設(shè)施和評估框架!

- 模型:https://huggingface.co/allenai

- 技術(shù)報告:https://allenai.org/papers/tulu-3-report.pdf

- 數(shù)據(jù)集:https://huggingface.co/collections/allenai/tulu-3-datasets-673b8df14442393f7213f372

- GitHub:https://github.com/allenai/open-instruct

- Demo:https://playground.allenai.org/

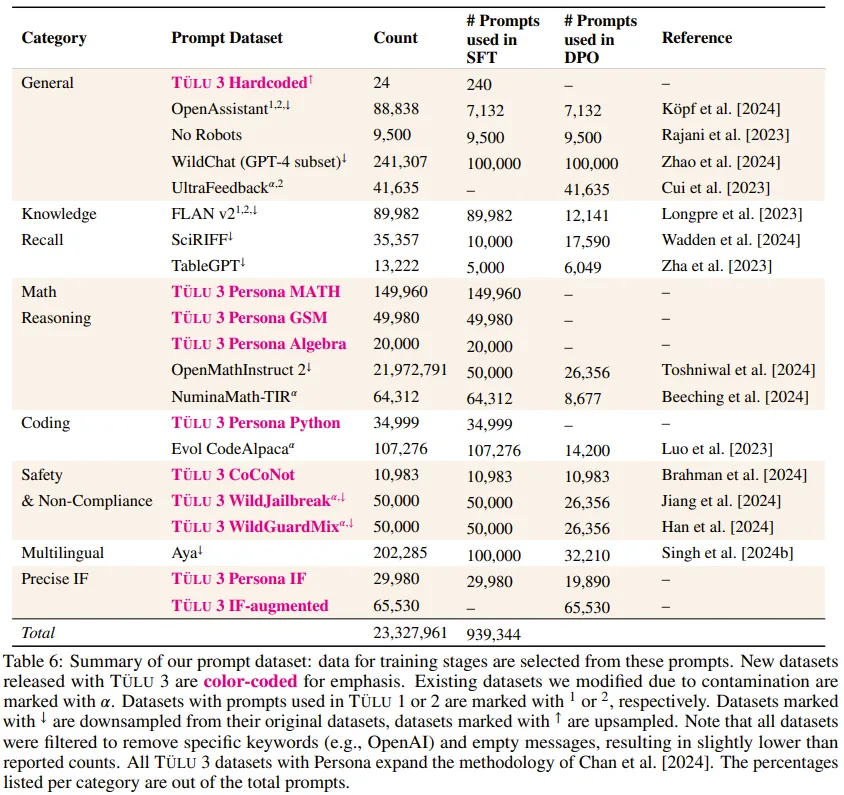

下表展示了 Ai2 開源的模型、數(shù)據(jù)集和代碼:

Ai2 表示,Tülu 3 突破了后訓(xùn)練研究的界限,縮小了開放和封閉微調(diào)配方之間的性能差距。

為此,他們創(chuàng)建了新的數(shù)據(jù)集和新的訓(xùn)練流程。他們還提出了直接使用強化學(xué)習(xí)在可驗證問題上訓(xùn)練的新方法,以及使用模型自己的生成結(jié)果創(chuàng)建高性能偏好數(shù)據(jù)的新方法。

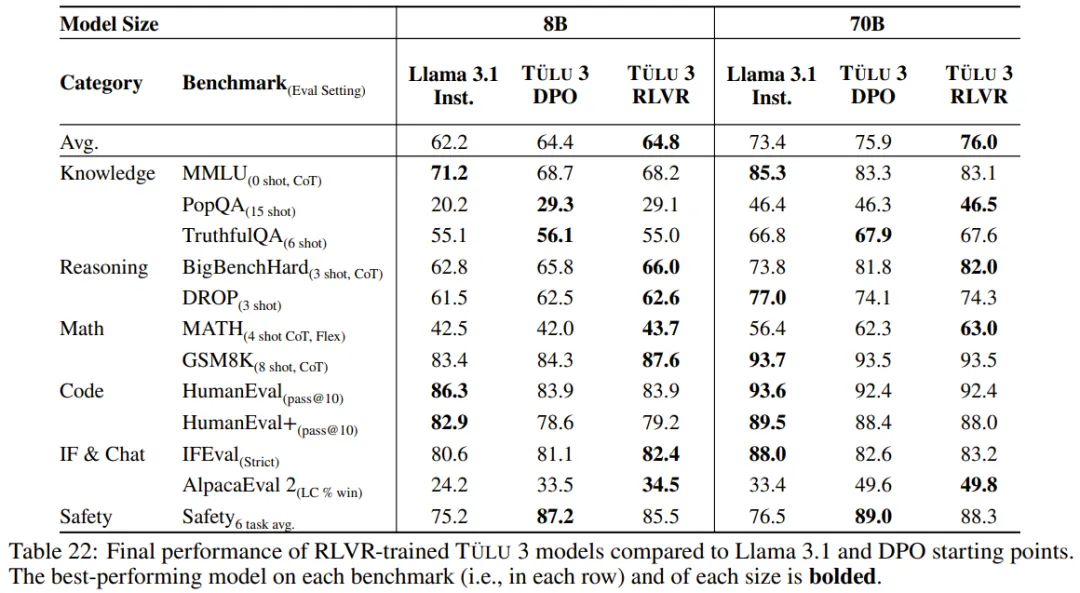

加上更多優(yōu)化細節(jié),得到的 Tülu 3 系列模型明顯優(yōu)于同等規(guī)模的其它模型。

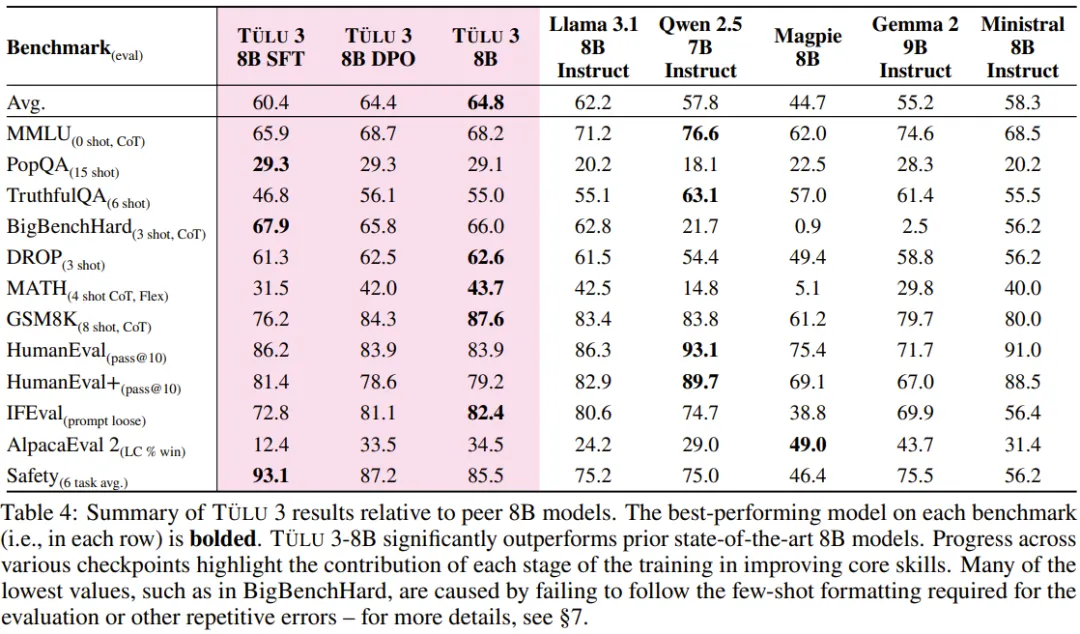

8B 模型在各基準上的表現(xiàn)

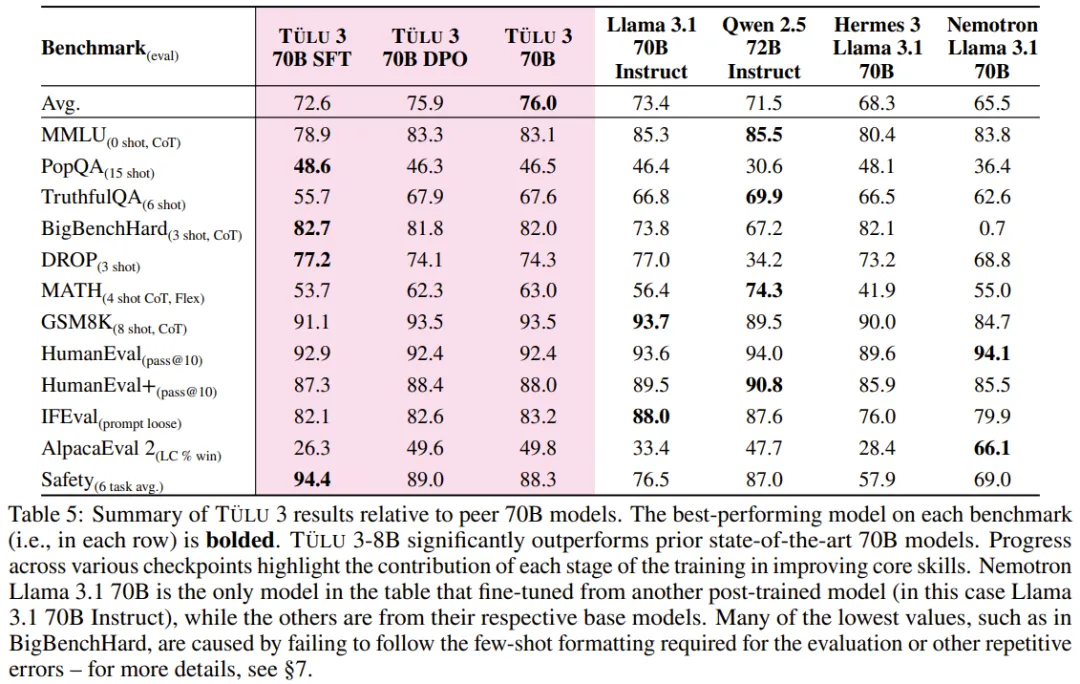

70B 模型在各基準上的表現(xiàn)

Tülu 3 是如何煉成的?

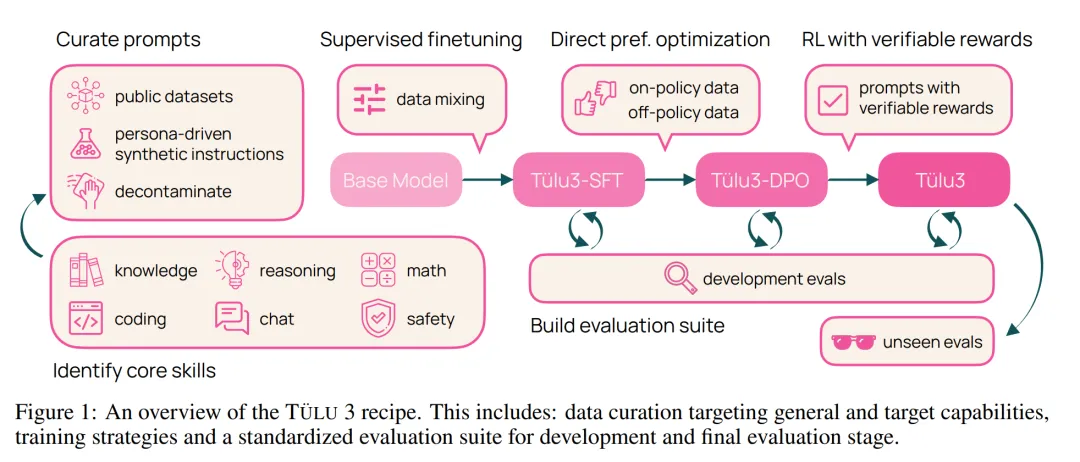

Ai2 在預(yù)訓(xùn)練語言模型的基礎(chǔ)上,通過四個階段的后訓(xùn)練方法生成 Tülu 3 模型(見圖 1)。這套訓(xùn)練流程結(jié)合了強化學(xué)習(xí)中的新算法改進、尖端基礎(chǔ)設(shè)施和嚴格的實驗,以便在各個訓(xùn)練階段整理數(shù)據(jù)并優(yōu)化數(shù)據(jù)組合、方法和參數(shù)。

這些階段如下:

- 階段一:數(shù)據(jù)整理。Ai2 整理了各種提示(prompt)信息,并將其分配到多個優(yōu)化階段。他們創(chuàng)建了新的合成提示,或在可用的情況下,從現(xiàn)有數(shù)據(jù)集中獲取提示,以針對特定能力。他們確保了提示不受評估套件 Tülu 3 EVAL 的污染。

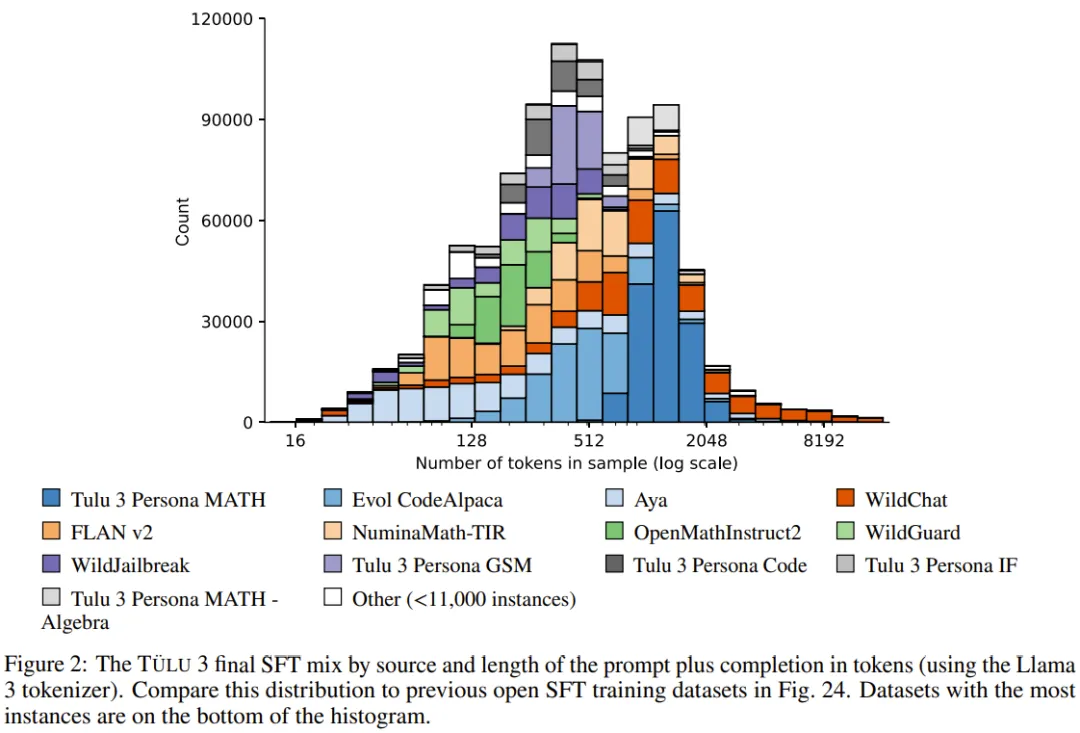

- 階段二:監(jiān)督微調(diào)。Ai2 利用精心挑選的提示和回答結(jié)果進行監(jiān)督微調(diào)(SFT)。在評估框架指導(dǎo)下,他們通過全面的實驗,確定最終的 SFT 數(shù)據(jù)和訓(xùn)練超參數(shù),以增強目標核心技能,同時不對其他技能的性能產(chǎn)生重大影響。

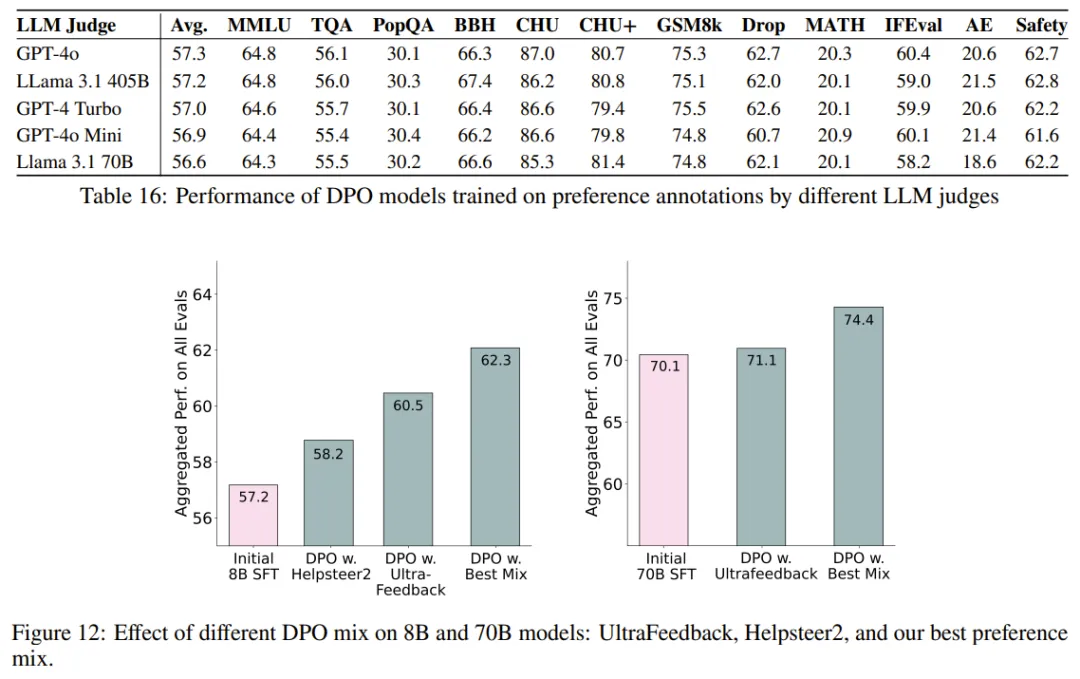

- 階段三:偏好微調(diào)。Ai2 將偏好微調(diào) —— 特別是 DPO(直接偏好優(yōu)化)—— 應(yīng)用于根據(jù)選定的提示和 off-policy 數(shù)據(jù)構(gòu)建的新 on-policy 合成偏好數(shù)據(jù)。與 SFT 階段一樣,他們通過全面的實驗來確定最佳偏好數(shù)據(jù)組合,從而發(fā)現(xiàn)哪些數(shù)據(jù)格式、方法或超參數(shù)可帶來改進。

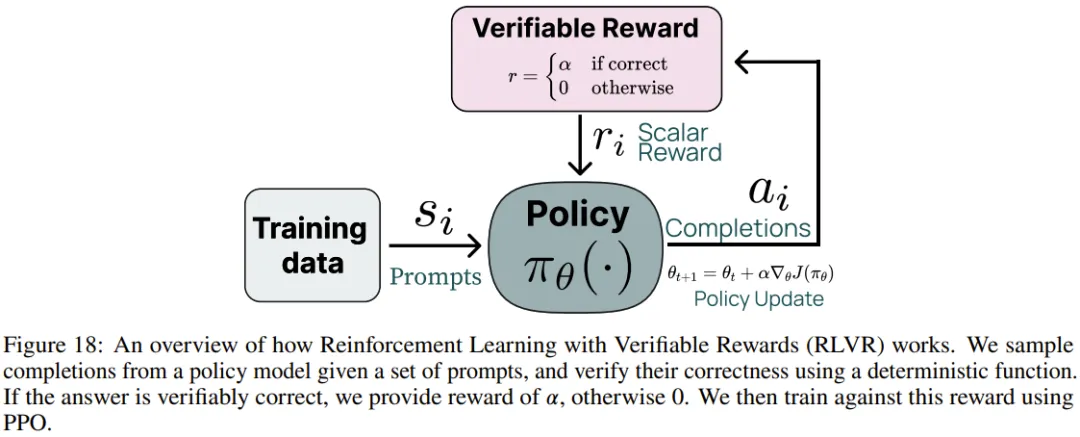

- 階段四:具有可驗證獎勵的強化學(xué)習(xí)。Ai2 引入了一個新的基于強化學(xué)習(xí)的后訓(xùn)練階段,該階段通過可驗證獎勵(而不是傳統(tǒng) RLHF PPO 訓(xùn)練中常見的獎勵模型)來訓(xùn)練模型。他們選擇了結(jié)果可驗證的任務(wù),例如數(shù)學(xué)問題,并且只有當模型的生成被驗證為正確時才提供獎勵。然后,他們基于這些獎勵進行強化學(xué)習(xí)訓(xùn)練。

Tülu 3 pipeline 的主要貢獻在于數(shù)據(jù)、方法、基礎(chǔ)設(shè)施的改進和嚴格的評估。其中的關(guān)鍵要素包括:

- 數(shù)據(jù)質(zhì)量、出處和規(guī)模:Ai2 通過仔細調(diào)查可用的開源數(shù)據(jù)集、分析其出處、凈化來獲取提示,并針對核心技能策劃合成提示。為確保有效性,他們進行了全面的實驗,研究它們對評估套件的影響。他們發(fā)現(xiàn)有針對性的提示對提高核心技能很有影響,而真實世界的查詢(如 WildChat)對提高通用聊天能力很重要。利用 Tülu 3 EVAL 凈化工具,他們可以確保提示不會污染評估套件。

- 創(chuàng)建多技能 SFT 數(shù)據(jù)集。通過利用不同數(shù)據(jù)混合結(jié)果進行幾輪有監(jiān)督微調(diào),Ai2 優(yōu)化了「通用」和「特定技能」類別中提示的分布。例如,為了提高數(shù)學(xué)推理能力,Ai2 首先通過創(chuàng)建數(shù)學(xué)專業(yè)模型在評估套件中建立一個上限,然后混合數(shù)據(jù),使通用模型更接近這個上限。

- 編排一個 On-Policy 偏好數(shù)據(jù)集。Ai2 開發(fā)了一個 on-policy 數(shù)據(jù)編排 pipeline,以擴展偏好數(shù)據(jù)集生成。具體來說,他們根據(jù)給定的提示從 Tülu 3-SFT 和其他模型中生成完成結(jié)果,并通過成對比較獲得偏好標簽。他們的方法擴展并改進了 Cui et al. [2023] 提出的 off-policy 偏好數(shù)據(jù)生成方法。通過對偏好數(shù)據(jù)進行精心的多技能選擇,他們獲得了 354192 個用于偏好調(diào)整的實例,展示了一系列任務(wù)的顯著改進。

- 偏好調(diào)整算法設(shè)計。Ai2 對幾種偏好調(diào)整算法進行了實驗,觀察到使用長度歸一化( length-normalized)直接偏好優(yōu)化的性能有所提高。他們在實驗中優(yōu)先考慮了簡單性和效率,并在整個開發(fā)過程和最終模型訓(xùn)練中使用了長度歸一化直接偏好優(yōu)化算法,而不是對基于 PPO 的方法進行成本更高的研究。

- 具有可驗證獎勵的特定技能強化學(xué)習(xí)。Ai2 采用了一種新方法,利用標準強化學(xué)習(xí)范式,針對可以對照真實結(jié)果(如數(shù)學(xué))進行評估的技能進行強化學(xué)習(xí)。他們將這種算法稱為「可驗證獎勵強化學(xué)習(xí)」(RLVR)。結(jié)果表明,RLVR 可以提高模型在 GSM8K、MATH 和 IFEval 上的性能。

- 用于強化學(xué)習(xí)的訓(xùn)練基礎(chǔ)設(shè)施。Ai2 實現(xiàn)了一種異步式強化學(xué)習(xí)設(shè)置:通過 vLLM 高效地運行 LLM 推理,而學(xué)習(xí)器還會同時執(zhí)行梯度更新。并且 Ai2 還表示他們的強化學(xué)習(xí)代碼庫的擴展性能非常好,可用于訓(xùn)練 70B RLVR 策略模型。

Tülu 3 的表現(xiàn)如何?

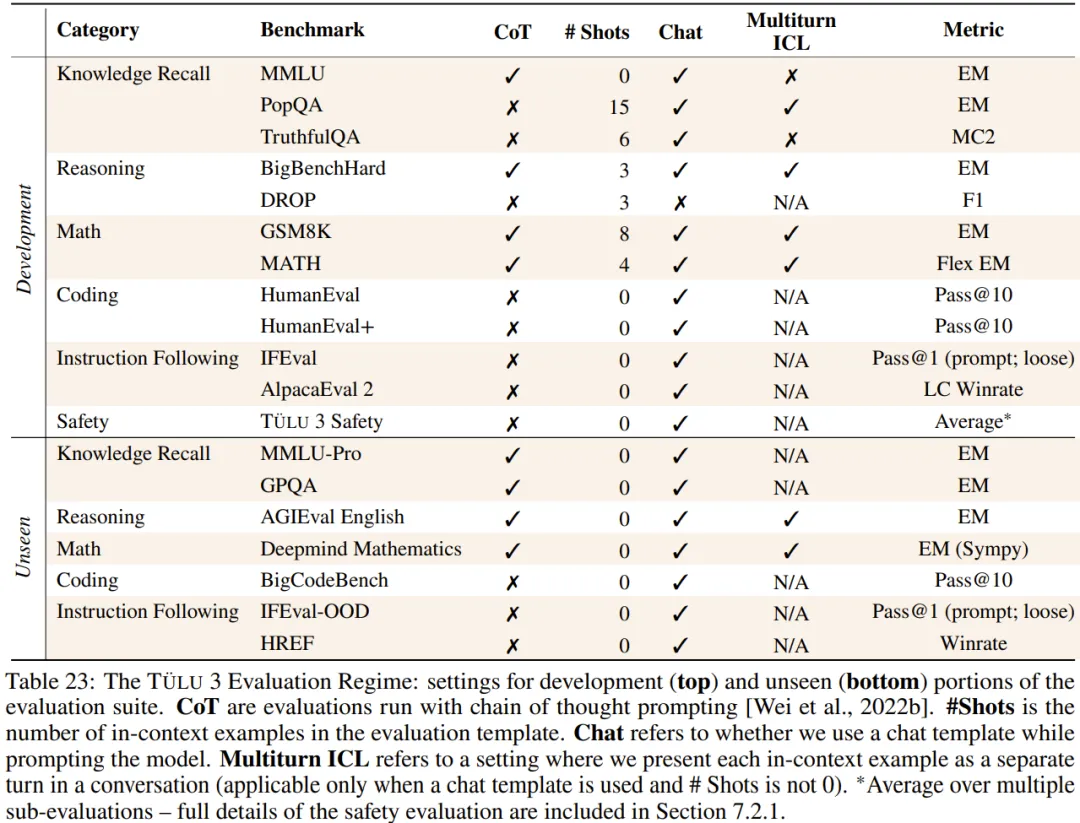

為了評估 Tülu 3 以及其它模型,Ai2 設(shè)計了一套評估框架,其中包含一個用于可重復(fù)評估的開放評估工具包、一套用于評估指令微調(diào)模型的核心技能的套件(具有分立的開發(fā)和留存評估),以及一組推薦設(shè)置(基于 Ai2 對各種模型的實驗)——Ai2 稱之為 Tülu 3 Evaluation Regime。

除了評估最終模型,該框架還是一個開放的評估工具套件,旨在通過精心挑選的評估套件和凈化工具來引導(dǎo)開發(fā)進度。

下面展示了一些主要的評估結(jié)果。可以看到,同等規(guī)模性,在這些基準上,Tülu 3 的表現(xiàn)非常出色,其中 70B 版本的平均性能甚至可與 Claude 3.5 Haiku 比肩。

此外,Ai2 還提出了兩個新的評估基準:IFEval-OOD 和 HREF。

IFEval-OOD 的目標是測試 LLM 遵從精確指令的能力,以及它們是否能夠遵從超出 IFEval 中包含的 25 個約束的指令約束。IFEval-OOD 包含 6 大類 52 個約束。

HREF 的全稱是 Human Reference-guided Evaluation of instruction Following,即人類偏好指導(dǎo)的指令遵從評估,其目標是自動評估語言模型遵從指令的能力。HREF 專注于語言模型通常訓(xùn)練的 11 個指令遵從任務(wù),即頭腦風(fēng)暴、開放式 QA、封閉式 QA、提取、生成、重寫、總結(jié)、分類、數(shù)值推理、多文檔合成和事實核查。

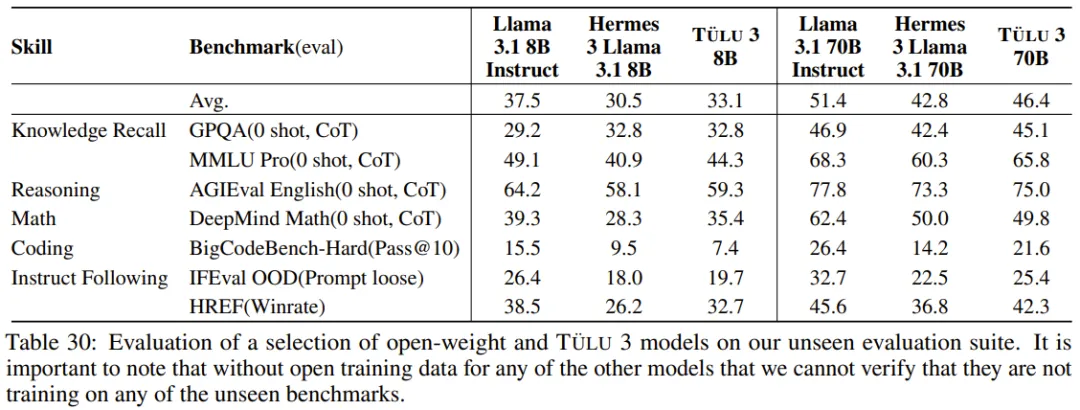

下表給出了 Tülu 3 與對比模型在這兩個新基準以及其它已有基準上的表現(xiàn),具體涉及的領(lǐng)域包括知識調(diào)用、推理、數(shù)學(xué)、編程和指令遵從。需要注意,這些都是 Unseen 基準,即這些任務(wù)是模型訓(xùn)練過程中未見過的。

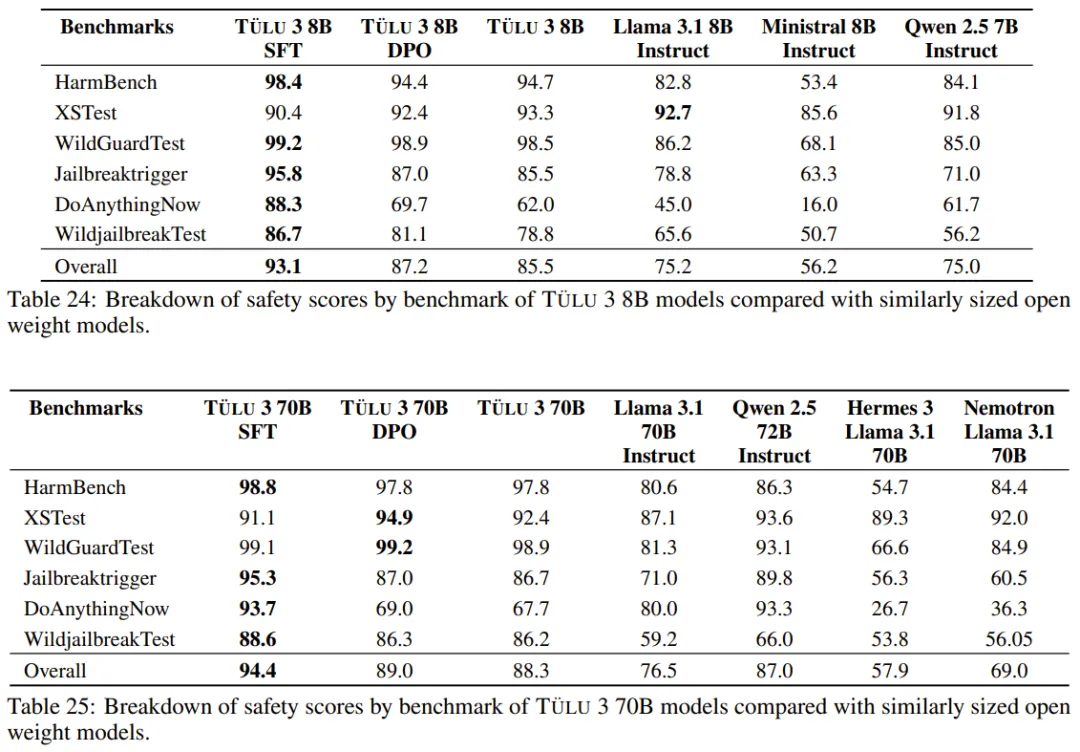

安全性方面,以下兩表展示了 Tülu 3 與對比模型在兩個基準上的安全分數(shù)。整體而言,同等規(guī)模下,Tülu 3 相較于其它開源模型更有優(yōu)勢。

最后必須說明,長達 73 頁的 Tülu 3 技術(shù)報告中還包含大量本文并未提及的細節(jié),感興趣的讀者千萬不要錯過。