調(diào)試神經(jīng)網(wǎng)絡(luò)讓人抓狂?這有16條錦囊妙計(jì)送給你

作者:Andrey Nikishaev

即便對(duì)于行家來說,調(diào)試神經(jīng)網(wǎng)絡(luò)也是一項(xiàng)艱巨的任務(wù)。數(shù)百萬(wàn)個(gè)參數(shù)擠在一起,一個(gè)微小的變化就能毀掉所有辛勤工作的成果。然而不進(jìn)行調(diào)試以及可視化,一切就只能靠運(yùn)氣,最后可能浪費(fèi)掉大把的青春歲月。

即便對(duì)于行家來說,調(diào)試神經(jīng)網(wǎng)絡(luò)也是一項(xiàng)艱巨的任務(wù)。數(shù)百萬(wàn)個(gè)參數(shù)擠在一起,一個(gè)微小的變化就能毀掉所有辛勤工作的成果。然而不進(jìn)行調(diào)試以及可視化,一切就只能靠運(yùn)氣,最后可能浪費(fèi)掉大把的青春歲月。

怎么辦?這里是我總結(jié)的一些方法,希望對(duì)你有所幫助。

1.數(shù)據(jù)集問題

嘗試用小數(shù)據(jù)集來過擬合你的模型

一般來說,幾百次迭代后神經(jīng)網(wǎng)絡(luò)就會(huì)對(duì)數(shù)據(jù)過擬合。如果損失還不下降,那么問題可能就深了。

使用迭代邏輯來解決問題

先建立一個(gè)最小的網(wǎng)絡(luò)來解決核心問題,然后一步一步擴(kuò)展到全局問題。比方構(gòu)建一個(gè)風(fēng)格遷移網(wǎng)絡(luò),應(yīng)該首先在一張圖片上訓(xùn)練。成功之后,再構(gòu)建一個(gè)可以對(duì)任意圖片實(shí)現(xiàn)風(fēng)格遷移的模型。

使用帶有失真的平衡數(shù)據(jù)集

以訓(xùn)練模型進(jìn)行數(shù)據(jù)分類為例,每一類的輸入訓(xùn)練數(shù)據(jù)量應(yīng)該一致。不然會(huì)出現(xiàn)某一類的過擬合。神經(jīng)網(wǎng)絡(luò)對(duì)于所有失真應(yīng)該具有不變性,你需要特別訓(xùn)練這一點(diǎn)。所以輸入一些失真數(shù)據(jù),有助于提高網(wǎng)絡(luò)的準(zhǔn)確率。

網(wǎng)絡(luò)容量與數(shù)據(jù)大小

數(shù)據(jù)集應(yīng)該足以讓網(wǎng)絡(luò)完成學(xué)習(xí)。如果大網(wǎng)絡(luò)配上小數(shù)據(jù)集,學(xué)習(xí)過程就會(huì)停止,有可能一大堆輸入都得出同樣的輸出。如果小網(wǎng)絡(luò)配上大數(shù)據(jù)集,你會(huì)遇見損失的跳躍,因?yàn)榫W(wǎng)絡(luò)容量存儲(chǔ)不了這么多信息。

使用平均中心化

這有助于從網(wǎng)絡(luò)中去除噪音數(shù)據(jù),并且提高訓(xùn)練效果,在某些情況下還有助于解決NaN問題。不過切記對(duì)于時(shí)間序列數(shù)據(jù),應(yīng)該使用批量中心化而不是全局。

2.神經(jīng)網(wǎng)絡(luò)問題

首先嘗試簡(jiǎn)單的模型

我看到太多人一上來就嘗試ResNet-50、VGG19等標(biāo)準(zhǔn)的大型網(wǎng)絡(luò),結(jié)果發(fā)現(xiàn)他們的問題其實(shí)只要幾層網(wǎng)絡(luò)就能解決。所以如果不是有什么戀大的情結(jié),麻煩你從小型網(wǎng)絡(luò)開始著手。

增加的東西越多,越難訓(xùn)練出一個(gè)解決問題的模型。從小網(wǎng)絡(luò)開始訓(xùn)練,可以節(jié)省更多的時(shí)間。以及,大網(wǎng)絡(luò)會(huì)占用更多的內(nèi)存和運(yùn)算。

必須可視化

如果用TensorFlow,那就必須用Tensorboard。否則,請(qǐng)為你的框架找到別的可視化工具,或者自己寫一個(gè)。因?yàn)檫@有助于你在訓(xùn)練早期階段發(fā)現(xiàn)問題。你應(yīng)該明確的看到這些數(shù)據(jù):損失、權(quán)重直方圖、變量和梯度。

如果是處理計(jì)算機(jī)視覺方面的工作,始終要對(duì)過濾器進(jìn)行可視化,這樣才能清楚的了解網(wǎng)絡(luò)正在看到的是什么內(nèi)容。

權(quán)重初始化

如果不能正確的設(shè)置權(quán)重,你的網(wǎng)絡(luò)可能會(huì)因?yàn)樘荻认У仍蜃兊脽o法學(xué)習(xí)。以及你要知道權(quán)重和學(xué)習(xí)率互相結(jié)合,大學(xué)習(xí)率和大權(quán)重可能導(dǎo)致NaN問題。

對(duì)于小型網(wǎng)絡(luò),在1e-2~1e-3附近使用一些高斯分布初始化器就夠了。

對(duì)于深層網(wǎng)絡(luò)這沒什么用,因?yàn)闄?quán)重將相乘多次,這會(huì)帶來非常小的數(shù)字,幾乎可以消除反向傳播那步的梯度。多虧了Ioffe和Szegedy,我們現(xiàn)在有了Batch-Normalization(批量歸一化),這能減少好多麻煩。

標(biāo)準(zhǔn)問題使用標(biāo)準(zhǔn)網(wǎng)絡(luò)

有很多你立馬就能用的預(yù)訓(xùn)練模型。在某些情況下,你可以直接使用這些模型,也可以進(jìn)行微調(diào)節(jié)省訓(xùn)練時(shí)間。核心思想是,對(duì)于不同的問題,大多數(shù)網(wǎng)絡(luò)的容量是一樣的。比方,搞計(jì)算機(jī)視覺,那么網(wǎng)絡(luò)的第一層就是由簡(jiǎn)單的過濾器構(gòu)成,例如線、點(diǎn)等等,所有的圖片都是如此,根本不需要重新訓(xùn)練。

使用學(xué)習(xí)率衰減

這總能對(duì)你有所幫助。TensorFlow里面有很多可以用的衰減調(diào)度器。

使用網(wǎng)格搜索或隨機(jī)搜索或配置文件來調(diào)整超參數(shù)

不要手動(dòng)檢查所有的參數(shù),這樣耗時(shí)而且低效。我通常對(duì)所有參數(shù)使用全局配置,檢查運(yùn)行結(jié)果之后,我回進(jìn)一步研究改進(jìn)的方向。如果這種方法沒有幫助,那么你可以使用隨機(jī)搜索或者網(wǎng)格搜索。

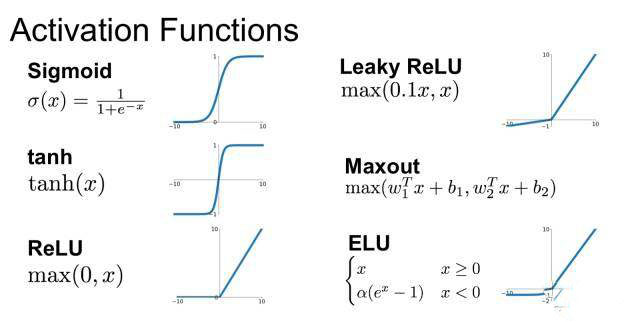

3.關(guān)于激活函數(shù)

1、關(guān)于梯度消失的問題

例如Sigmoid以及Tanh等激活函數(shù)存在飽和問題,也就是在函數(shù)的一端,激活函數(shù)的導(dǎo)數(shù)會(huì)趨近于零,這會(huì)“殺死”梯度和學(xué)習(xí)過程。所以換用不同的激活函數(shù)是個(gè)好主意。現(xiàn)在標(biāo)準(zhǔn)的激活函數(shù)是ReLU。

此外這個(gè)問題也可能出現(xiàn)在非常深或者循環(huán)網(wǎng)絡(luò)中,例如對(duì)于一個(gè)150層的網(wǎng)絡(luò),所有的激活函數(shù)都給定為0.9,那么0.9¹⁵⁰ = 0,000000137。正如我上面提到的,批量歸一化有助于解決這個(gè)問題。

2、非零中心激活函數(shù)

Sigmoid、ReLU都不是以零為中心的激活函數(shù)。這意味著在訓(xùn)練期間,所有的梯度都將是正(或者負(fù))的,這會(huì)導(dǎo)致學(xué)習(xí)過程中出現(xiàn)問題。這也是為什么我們使用零中心化的輸入數(shù)據(jù)。

3、無效ReLU

標(biāo)準(zhǔn)的ReLU函數(shù)也不完美。對(duì)于負(fù)數(shù),ReLU會(huì)給出0,這意味著函數(shù)沒有激活。換句話說,神經(jīng)元有一部分從未被使用過。發(fā)生這種情況的原因,主要是使用了大學(xué)習(xí)率以及錯(cuò)誤的權(quán)重初始化。如果參數(shù)調(diào)整不能幫你解決這個(gè)問題,可以嘗試Leaky ReLU、PReLU、ELU或者M(jìn)axout等函數(shù)。

4、梯度爆炸

這個(gè)問題與梯度消失差不多,只不過是每一步梯度越來越大。一個(gè)解決的方案是使用梯度裁剪,也就是給梯度下了一個(gè)硬限制。

4.深層網(wǎng)絡(luò)的網(wǎng)絡(luò)精度退化

非常深層的網(wǎng)絡(luò)有個(gè)問題,就是會(huì)從某些點(diǎn)開始表現(xiàn)就完全崩了。這是因?yàn)樵黾痈嗟膶訒?huì)讓網(wǎng)絡(luò)的精度降低。解決的辦法是使用殘差層,保證部分輸入可以穿過所有層。殘差網(wǎng)絡(luò)如下圖所示。

如果上述種種沒有提到你遇見的問題,你可以聯(lián)系作者進(jìn)一步討論,作者在推特上的ID是:creotiv。

責(zé)任編輯:龐桂玉

來源:

36大數(shù)據(jù)