賈佳亞團(tuán)隊新作MagicMirror:生成身份一致且高質(zhì)量個性化視頻,效果驚艷!

文章鏈接:https://arxiv.org/pdf/2501.03931

項目鏈接:https://julianjuaner.github.io/projects/MagicMirror/

亮點直擊

- 提出了Magic Mirror,這是一種無需微調(diào)的新型框架,用于生成身份一致性的視頻;

- 設(shè)計了一種輕量級適配器,結(jié)合條件自適應(yīng)歸一化,實現(xiàn)面部嵌入在全注意力擴(kuò)散Transformer架構(gòu)中的有效融合;

- 開發(fā)了一種數(shù)據(jù)集構(gòu)建方法,通過合成數(shù)據(jù)生成和漸進(jìn)式訓(xùn)練策略相結(jié)合,解決個性化視頻生成中的數(shù)據(jù)稀缺問題。

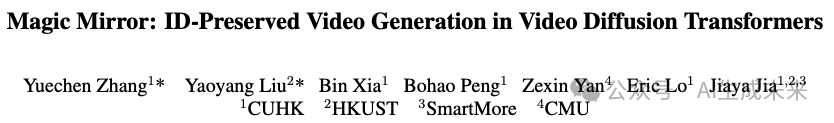

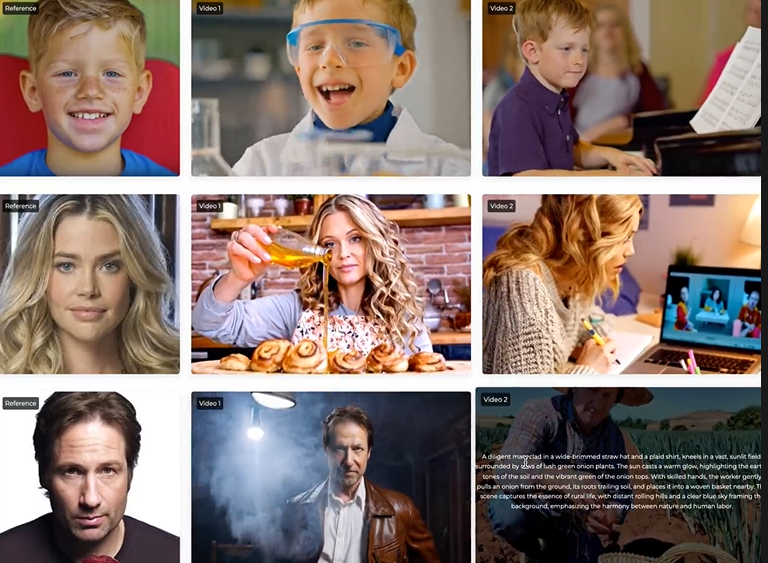

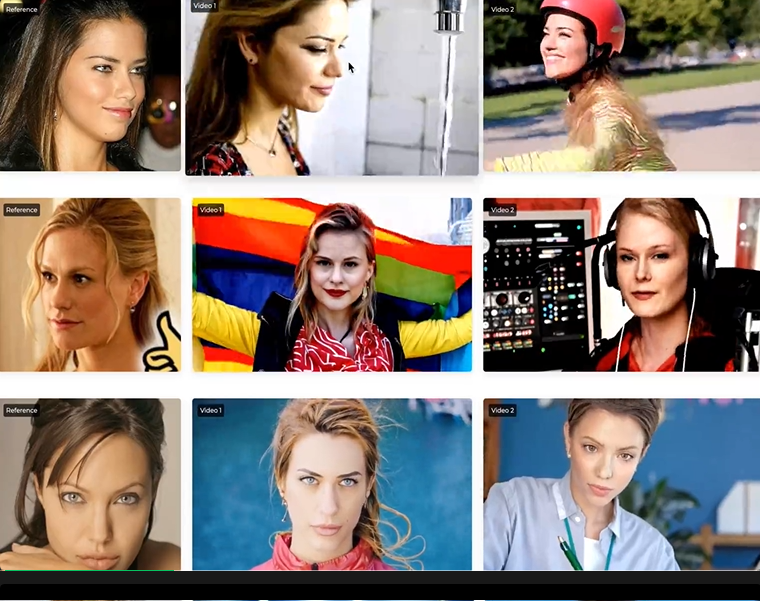

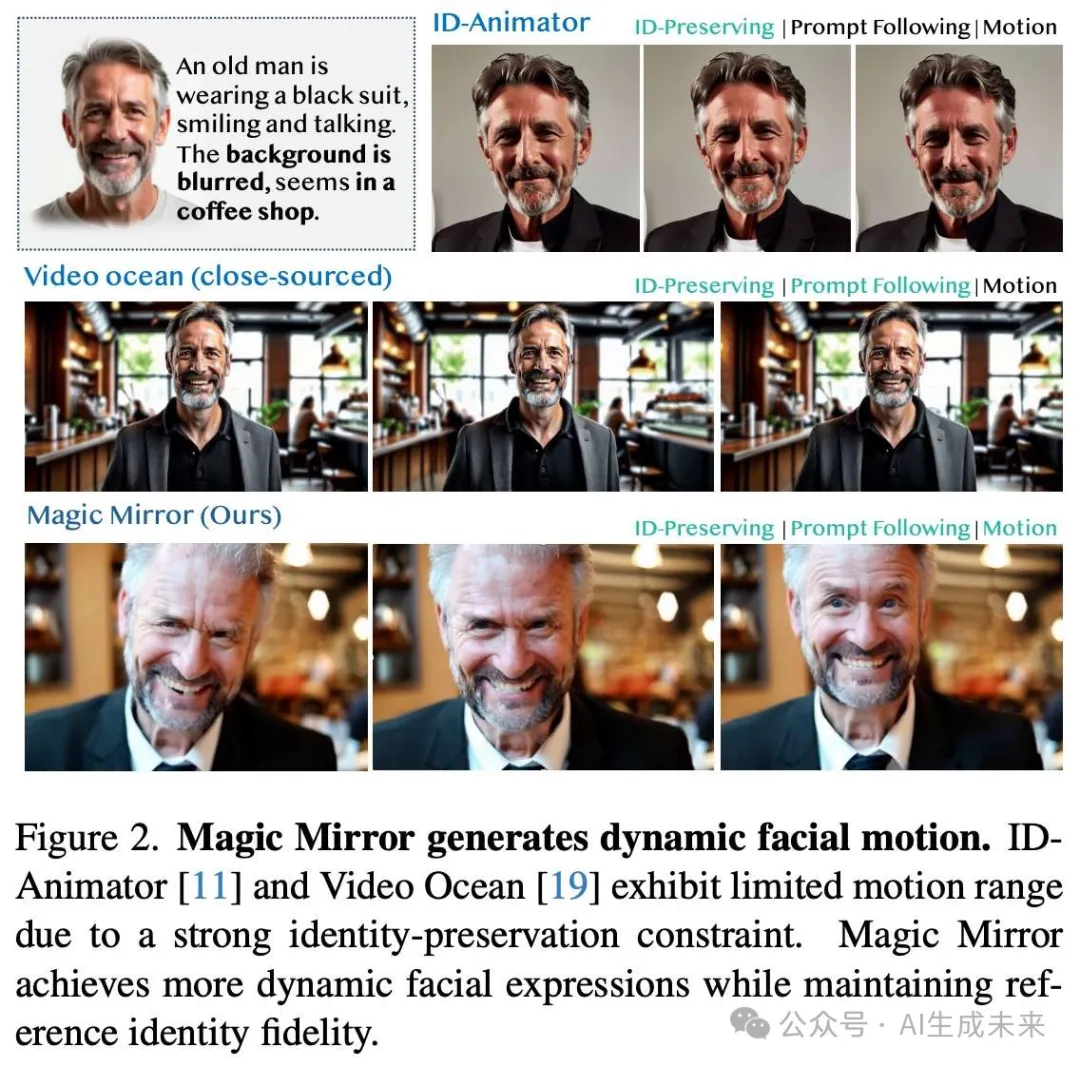

效果速覽

總結(jié)速覽

解決的問題

- 當(dāng)前視頻生成方法在身份(ID)一致性和自然動態(tài)性之間難以平衡:

- 現(xiàn)有方法需要針對特定人物進(jìn)行微調(diào),或在生成動態(tài)內(nèi)容時無法保持身份一致性。

- 多數(shù)方法生成的視頻動態(tài)性不足,僅實現(xiàn)靜態(tài)的“復(fù)制粘貼”。

- 兩階段方法(圖像個性化+圖像到視頻生成)在長序列生成中缺乏穩(wěn)定性。

- 現(xiàn)有視頻生成模型(如全注意力的Video DiT)在文本-視頻對齊優(yōu)化中犧牲了空間保真度,導(dǎo)致細(xì)粒度身份特征難以保留。

- 高質(zhì)量、身份一致的圖像-視頻訓(xùn)練數(shù)據(jù)稀缺。

提出的方案

- 提出Magic Mirror單階段框架,用于生成高質(zhì)量、身份一致且動態(tài)自然的視頻。

- 引入三個關(guān)鍵組件:

- 利用身份一致的合成數(shù)據(jù)進(jìn)行初步訓(xùn)練。

- 在視頻數(shù)據(jù)上進(jìn)行細(xì)化訓(xùn)練,確保時序一致性。

- 集成到CogVideoX框架中。

- 采用條件自適應(yīng)歸一化(CAN),高效融合身份信息。

- 雙分支面部特征提取器:同時捕捉高層次身份特征和參考特定的結(jié)構(gòu)信息。

- 輕量級跨模態(tài)適配器:

- 兩階段訓(xùn)練策略:

應(yīng)用的技術(shù)

- 構(gòu)建于Video Diffusion Transformer(Video DiT)之上,優(yōu)化動態(tài)視頻生成。

- 條件自適應(yīng)歸一化(CAN)模塊:

- 融合身份條件,提供注意力引導(dǎo)和特征分布引導(dǎo)。

- 數(shù)據(jù)合成策略:

- 利用身份保留模型生成高質(zhì)量圖像-視頻對。

- 通過漸進(jìn)式學(xué)習(xí)方法,先進(jìn)行圖像預(yù)訓(xùn)練,再進(jìn)行視頻微調(diào)。

- 構(gòu)建人類中心的視頻生成測試集,用于評價生成質(zhì)量和一致性。

達(dá)到的效果

- 在身份一致性和自然動態(tài)性之間取得良好平衡:

- 動態(tài)視頻生成效果優(yōu)于現(xiàn)有方法。

- 在多項指標(biāo)上表現(xiàn)優(yōu)越,包括VBench等基準(zhǔn)測試。

- 通過無需人物特定微調(diào)的方法,實現(xiàn)個性化視頻生成:

- 保持面部一致性的同時,生成豐富的動態(tài)內(nèi)容。

- 低參數(shù)開銷的同時實現(xiàn)高質(zhì)量生成:

- 為數(shù)字化創(chuàng)作提供更多個性化、動態(tài)化的表達(dá)方式。

Magic Mirror

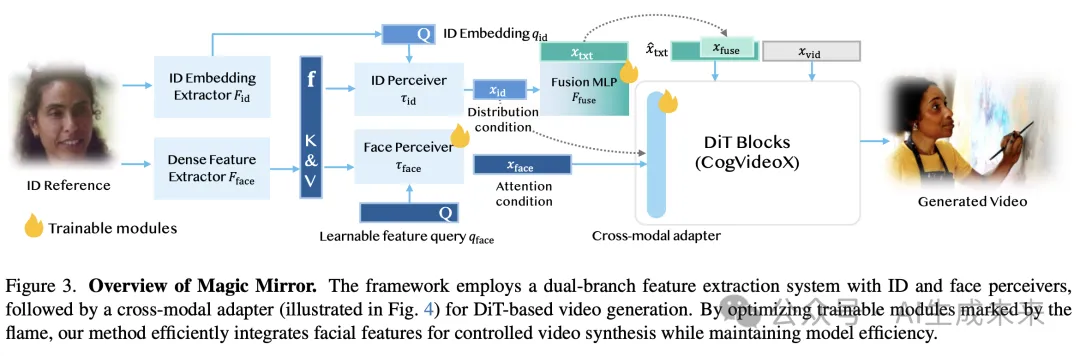

Magic Mirror 的概覽如下圖 3 所示。該雙分支框架從一個或多個參考圖像r 中提取面部身份特征。這些嵌入隨后通過增強(qiáng)了輕量級跨模態(tài)適配器的 DiT 主干進(jìn)行處理,并結(jié)合條件自適應(yīng)歸一化。該架構(gòu)使 Magic Mirror 能夠生成身份一致的文本到視頻輸出。

面部特征解耦提取

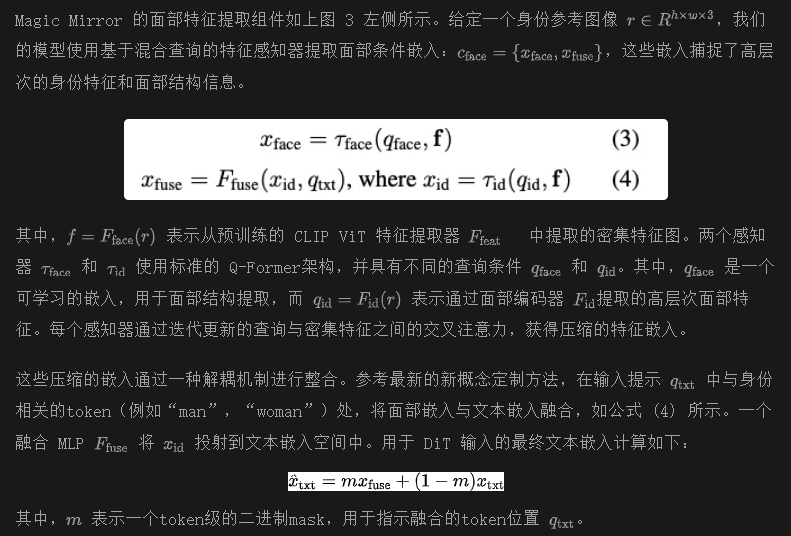

條件自適應(yīng)歸一化

其中,為簡潔起見,省略了模態(tài)特定的下標(biāo)。

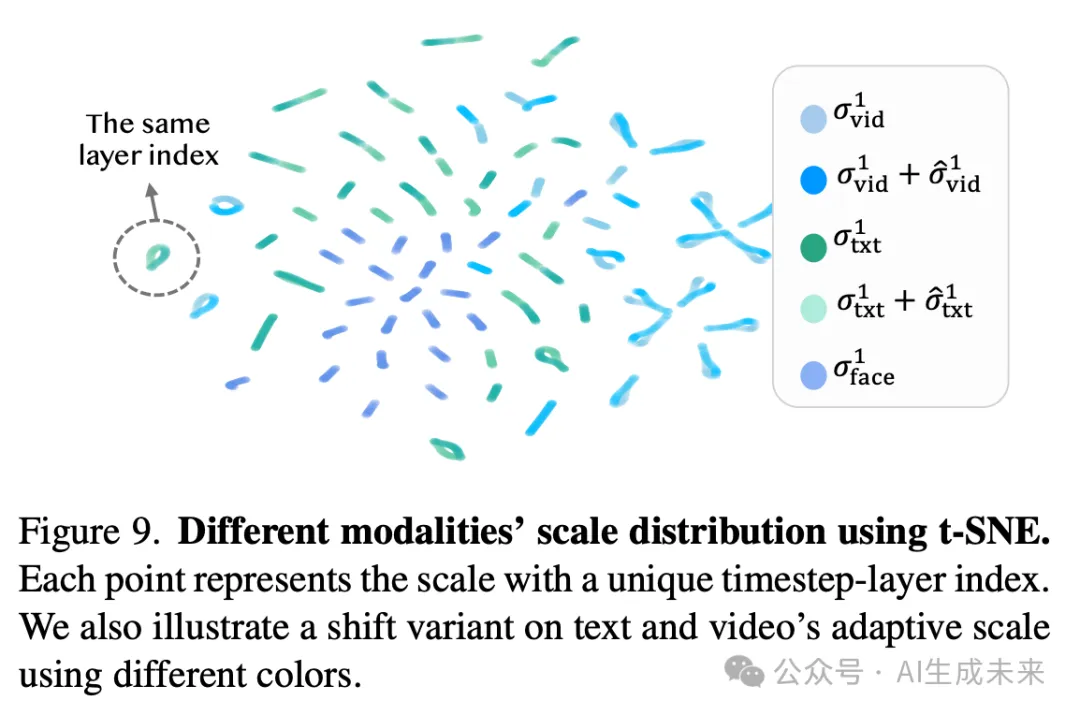

此外,為了增強(qiáng)特定參考身份(ID)的文本和視頻隱空間變量的分布學(xué)習(xí)能力,引入了條件自適應(yīng)歸一化(CAN),其靈感來自類條件的 DiT 和 StyleGAN 的條件控制方法。CAN 為視頻和文本模態(tài)預(yù)測分布偏移。

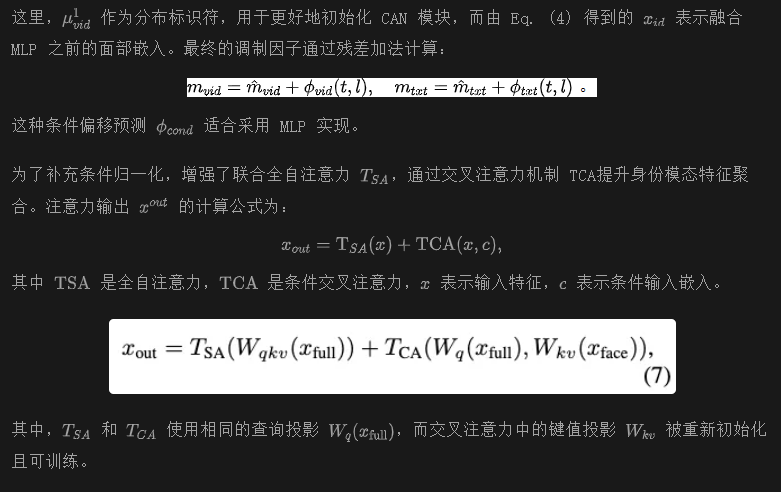

數(shù)據(jù)與訓(xùn)練

與諸如 Magic-Me 之類的微調(diào)方法相比,訓(xùn)練一個零樣本定制適配器面臨著獨特的數(shù)據(jù)挑戰(zhàn)。我們模型的全注意力架構(gòu)不可分割地結(jié)合了空間和時間組件,因此需要采用兩階段訓(xùn)練策略。如下圖 5 所示,首先在多樣性和高質(zhì)量數(shù)據(jù)集上訓(xùn)練,以培養(yǎng)穩(wěn)健的身份保持能力。

漸進(jìn)式訓(xùn)練pipeline利用多樣化的數(shù)據(jù)集來增強(qiáng)模型性能,特別是在身份保持方面。對于圖像預(yù)訓(xùn)練,首先使用 LAION-Face 數(shù)據(jù)集,該數(shù)據(jù)集包含大規(guī)模的網(wǎng)絡(luò)真實圖像,為生成自參考圖像提供了豐富的資源。為了進(jìn)一步增加身份的多樣性,使用了 SFHQ 數(shù)據(jù)集,該數(shù)據(jù)集應(yīng)用了標(biāo)準(zhǔn)文本提示的自參考技術(shù)。為了防止過擬合并促進(jìn)生成多樣化的臉部-頭部運(yùn)動,以 FFHQ 數(shù)據(jù)集為基礎(chǔ)。從一個人像描述提示池中隨機(jī)抽取文本提示,并使用 PhotoMaker-V2 生成身份條件的圖像對,通過精心的篩選確保身份的相似性和多樣性。

對于視頻后訓(xùn)練,利用了高質(zhì)量的 Pexels 和 Mixkit 數(shù)據(jù)集,以及從網(wǎng)絡(luò)自采的小規(guī)模視頻集合。同樣地,與每個關(guān)鍵幀的面部參考對應(yīng)的合成圖像數(shù)據(jù)被生成為參考。組合數(shù)據(jù)集為模型在圖像和視頻上的訓(xùn)練提供了豐富的視覺內(nèi)容。

目標(biāo)函數(shù)結(jié)合了身份感知和通用去噪損失:

實驗

實現(xiàn)細(xì)節(jié)

評估與比較將本文提出的方法與最先進(jìn)的身份一致視頻生成模型 ID-Animator 以及領(lǐng)先的圖像到視頻 (I2V) 框架(包括 DynamiCrafter、CogVideoX和 EasyAnimate)進(jìn)行了對比評估。評估中使用了標(biāo)準(zhǔn)化的視頻生成評測工具 VBench,以衡量運(yùn)動質(zhì)量和文本-運(yùn)動對齊性能。對于身份保持,采用面部識別嵌入相似度 和面部運(yùn)動指標(biāo)進(jìn)行評估。

評估數(shù)據(jù)集包括來自 VBench 的 40 個單角色提示(確保人口統(tǒng)計學(xué)的多樣性)以及 40 個特定動作提示用于運(yùn)動評估。身份參考從 PubFig 數(shù)據(jù)集中的 50 個面部身份中抽取,每個身份生成 4 個基于不同提示的個性化視頻。

定量評估

定量結(jié)果總結(jié)在下表1中。使用VBench和EvalCrafter的通用指標(biāo)評估生成的視頻,包括:

- 動態(tài)度:衡量生成視頻中動作的程度。

- 文本提示一致性:評估與給定文本描述的一致性。

- Inception Score (IS):評估生成視頻內(nèi)容的質(zhì)量和多樣性。

身份保持

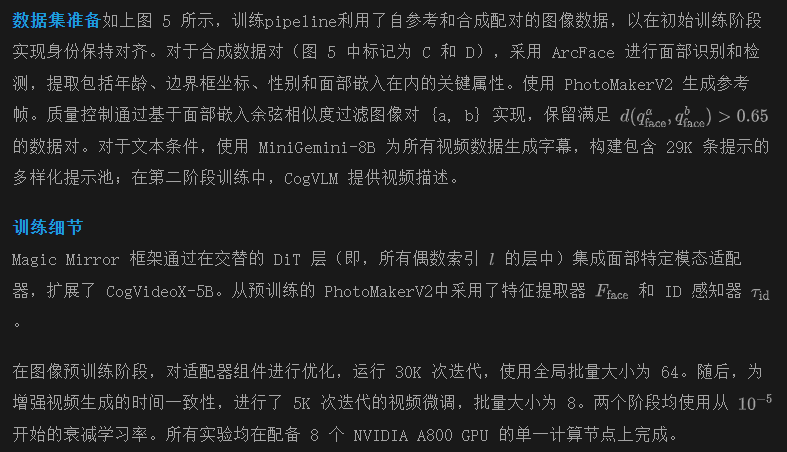

對于身份保持,引入了平均相似度,它評估生成的面部與每個身份參考圖像的平均相似度之間的距離。此方法避免了通過簡單的復(fù)制粘貼策略獲得人為的高分,如下圖2所示。

面部運(yùn)動指標(biāo)面部運(yùn)動使用兩個指標(biāo)進(jìn)行評估:

- FMref:衡量生成面部與參考面部之間的相對距離。

- FMinter:評估連續(xù)幀之間的距離。

定性評估

除了下圖1中展示的示例外,下圖6中展示了比較結(jié)果。與傳統(tǒng)的CogVideoX推理方法相比,本文的方法保持了較高的文本一致性、運(yùn)動動態(tài)和視頻質(zhì)量。與現(xiàn)有的圖像到視頻方法相比,Magic Mirror展示了在各幀之間更好的身份一致性,同時保持了自然的運(yùn)動。本文的方法還在動態(tài)范圍和文本對齊方面優(yōu)于ID-Animator,后者在運(yùn)動變化和提示遵循方面存在一定的局限性。

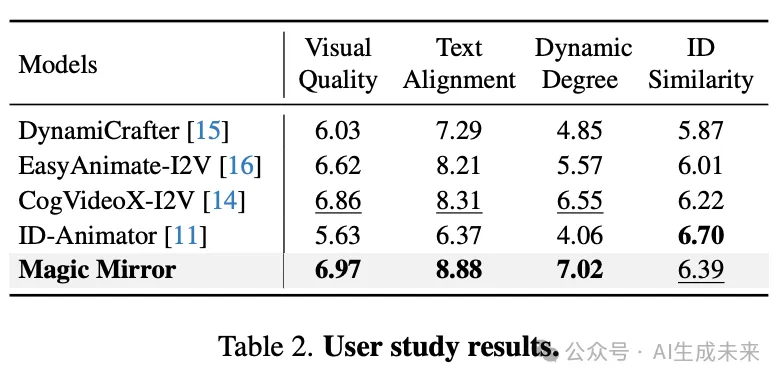

為了補(bǔ)充定量指標(biāo),進(jìn)行了全面的用戶研究,評估生成結(jié)果的感知質(zhì)量。該研究共涉及173名參與者,參與者評估了以下四個關(guān)鍵方面:運(yùn)動動態(tài)、文本-運(yùn)動對齊、視頻質(zhì)量和身份一致性。參與者按1-10分的尺度對每個方面進(jìn)行評分,結(jié)果總結(jié)在下表2中。如表1所示的總體偏好評分,Magic Mirror在所有評估維度上始終優(yōu)于基準(zhǔn)方法,展示了其在人類評估中的卓越感知質(zhì)量。

消融研究

與條件相關(guān)的模塊

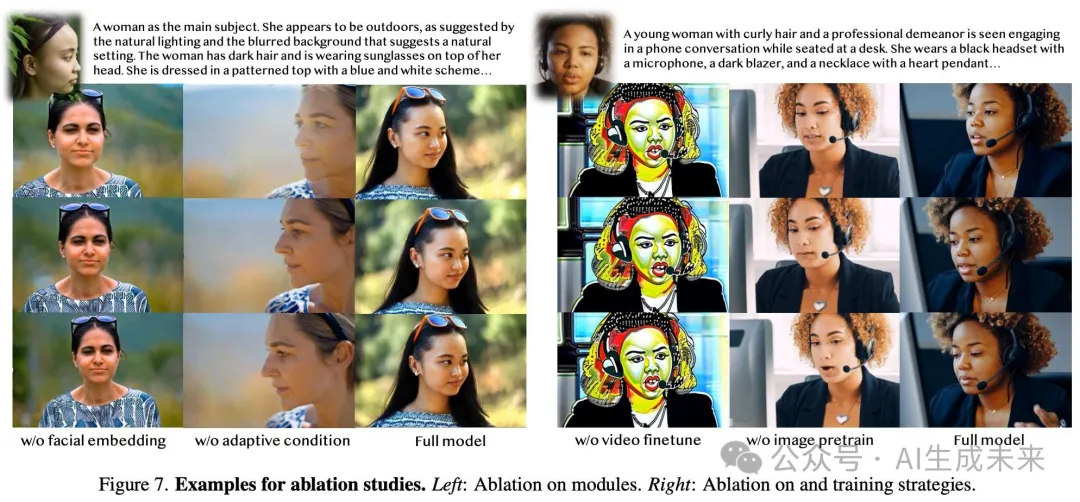

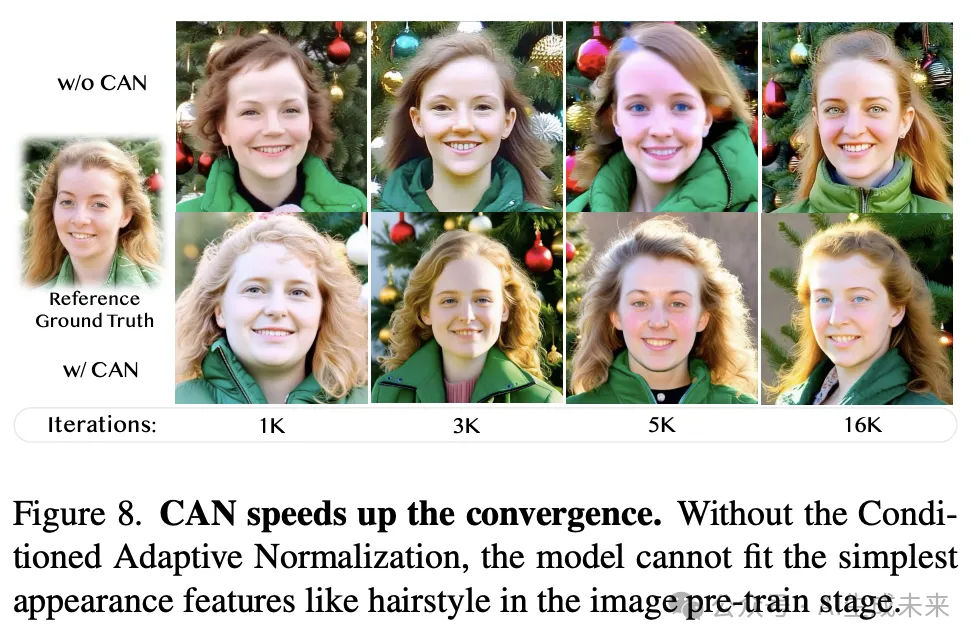

通過消融研究評估了關(guān)鍵架構(gòu)組件,結(jié)果展示在下圖7的左側(cè)。沒有參考特征嵌入分支時,模型失去了關(guān)鍵的高層次注意力引導(dǎo),導(dǎo)致身份忠實度顯著下降。條件自適應(yīng)歸一化(CAN)對于分布對齊至關(guān)重要,增強(qiáng)了跨幀的身份保持。下圖8進(jìn)一步展示了CAN在面部條件注入中的有效性,表明在圖像預(yù)訓(xùn)練階段,身份信息捕獲的訓(xùn)練收斂性得到了改善。

訓(xùn)練策略上圖7的右側(cè)展示了不同訓(xùn)練策略的影響。圖像預(yù)訓(xùn)練對于穩(wěn)健的身份保持至關(guān)重要,而視頻后訓(xùn)練確保了時間一致性。然而,僅在圖像數(shù)據(jù)上訓(xùn)練會導(dǎo)致視頻推理過程中出現(xiàn)顏色偏移偽影。這個偽影是由不同訓(xùn)練階段中調(diào)制因子不一致造成的。我們的兩階段訓(xùn)練方法通過利用兩個階段的優(yōu)勢,生成具有高身份忠實度和動態(tài)面部運(yùn)動的視頻,達(dá)到了最佳結(jié)果。

討論

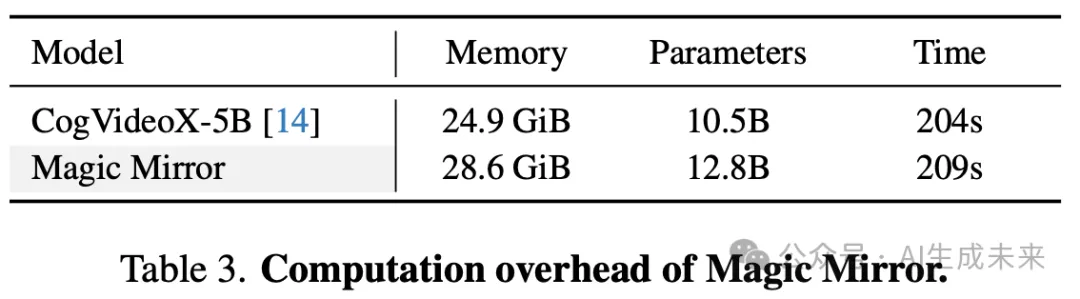

計算開銷與基準(zhǔn)模型相比,本文分析了生成一段49幀480P視頻時的GPU內(nèi)存利用、參數(shù)數(shù)量和推理延遲等計算要求。大多數(shù)附加參數(shù)集中在嵌入提取階段,這只需要一次前向傳遞。因此,如下表3所示,Magic Mirror在GPU內(nèi)存消耗和推理時間方面相較于基準(zhǔn)模型引入了最小的計算開銷。

限制與未來工作

盡管Magic Mirror在身份一致的視頻生成方面表現(xiàn)強(qiáng)勁,但仍然面臨一些挑戰(zhàn)。首先,當(dāng)前框架不支持多身份定制化生成。其次,本文的方法主要聚焦于面部特征,對于服飾和配件等細(xì)粒度屬性的保持仍有改進(jìn)空間。將身份一致性擴(kuò)展到這些更廣泛的視覺元素,代表了一個有前景的方向,適用于實際的多鏡頭定制視頻生成。

結(jié)論

Magic Mirror,一種zero-shot身份保持視頻生成框架。Magic Mirror將雙重面部嵌入和條件自適應(yīng)歸一化(CAN)集成到基于DiT的架構(gòu)中。本文的方法能夠?qū)崿F(xiàn)穩(wěn)健的身份保持和穩(wěn)定的訓(xùn)練收斂。大量實驗表明,Magic Mirror能夠生成高質(zhì)量的個性化視頻,同時保持單一參考圖像的身份一致性,在多個基準(zhǔn)和人工評估中優(yōu)于現(xiàn)有方法。

本文轉(zhuǎn)自AI生成未來 ,作者:AI生成未來